Einleitung: Die Verlockung ist real

Die Versprechen klingen verlockend. „Erstelle deine komplette Webseite in 5 Minuten.“ „Kein Coding nötig – AI macht alles.“ „Von der Idee zur fertigen Website mit einem einzigen Prompt.“ Überall siehst du Videos, in denen Menschen scheinbar mühelos professionelle Webseiten aus dem Nichts zaubern. Ein paar Worte eintippen, kurz warten, fertig.

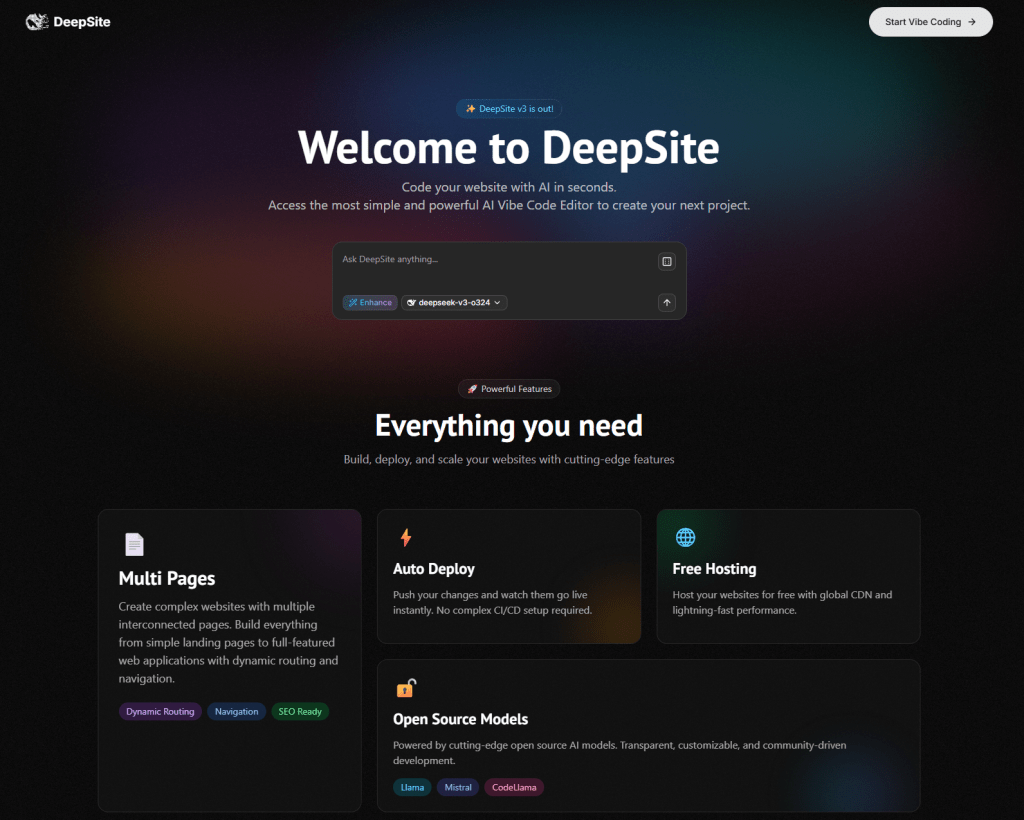

Und tatsächlich: Die Technologie ist beeindruckend. Tools wie ChatGPT, Claude, Midjourney, Framer AI, Durable, 10Web und dutzende andere können in Sekunden Texte generieren, Designs vorschlagen, sogar funktionierenden Code ausspucken. Was früher Wochen dauerte und tausende Euro kostete, scheint plötzlich für jeden zugänglich – kostenlos oder für wenige Euro im Monat.

Du hast es wahrscheinlich selbst ausprobiert. Vielleicht hast du ChatGPT gebeten, dir eine Landingpage zu schreiben. Vielleicht hast du einen AI-Website-Builder getestet. Vielleicht hast du stundenlang mit Prompts experimentiert, um das perfekte Ergebnis zu bekommen.

Und dann kam die Ernüchterung.

Die Texte klangen irgendwie… generisch. Das Design sah aus wie tausend andere Seiten. Die Conversion-Rate war miserabel. Besucher kamen, klickten herum, und verschwanden wieder. Oder noch schlimmer: Es kam gar niemand, weil Google die Seite ignorierte.

Du bist nicht allein. Millionen von Menschen erleben gerade dieselbe Enttäuschung. Sie wurden von der Magie der AI angelockt und stehen nun vor Webseiten, die technisch funktionieren, aber niemandem wirklich helfen – weder ihnen noch ihren Kunden.

Das Problem liegt nicht an der Technologie. AI ist tatsächlich ein mächtiges Werkzeug. Das Problem liegt an einem fundamentalen Missverständnis darüber, was AI kann und was nicht. Und genau dieses Missverständnis werden wir heute auflösen.

Das größte Problem: Die Illusion der „fertigen Webseite“

Lass mich direkt zum Kern kommen. Das größte Problem beim Webseiten bauen mit AI ist die Erwartung, dass AI eine fertige, funktionierende, konvertierende Webseite liefern kann – ohne dass du strategisch denkst.

Diese Erwartung ist verständlich. Die Marketing-Botschaften der AI-Tools suggerieren genau das. „Complete website in minutes.“ „Just describe your business and we do the rest.“ „No skills required.“

Aber hier liegt der fatale Denkfehler: Eine Webseite ist nicht einfach eine Sammlung von Texten und Bildern. Eine Webseite ist ein strategisches Werkzeug mit einem konkreten Ziel. Sie soll etwas bewirken – Leads generieren, Produkte verkaufen, Vertrauen aufbauen, informieren, überzeugen.

Wenn du AI bittest, „eine Webseite für mein Coaching-Business“ zu erstellen, fehlt ihr alles, was sie bräuchte, um diese Aufgabe wirklich zu erfüllen:

- Wer genau ist deine Zielgruppe?

- Welches spezifische Problem löst du?

- Was unterscheidet dich von hundert anderen Coaches?

- Welche Einwände haben potenzielle Kunden?

- In welcher Phase der Customer Journey befinden sich deine Besucher?

- Was sollen sie konkret tun, nachdem sie deine Seite besucht haben?

- Welchen Ton erwartet deine Zielgruppe?

- Welche Vertrauenssignale brauchen sie?

Ohne diese Informationen kann AI nur raten. Und raten bedeutet: generische Texte, austauschbare Designs, ineffektive Calls-to-Action. Das Ergebnis ist eine Webseite, die technisch existiert, aber strategisch tot ist.

Warum AI allein keine gute Webseite bauen kann

AI versteht dein Business nicht

AI wurde mit Milliarden von Texten trainiert. Sie kennt Muster, Strukturen, Formulierungen. Sie weiß, wie eine „typische“ Coaching-Webseite aussieht, weil sie tausende davon analysiert hat. Aber sie kennt dein spezifisches Business nicht.

Sie weiß nicht, dass deine Kunden meistens Frauen zwischen 35 und 50 sind, die nach einer Scheidung einen Neuanfang suchen. Sie weiß nicht, dass dein Hauptkonkurrent aggressive Verkaufstaktiken nutzt und du dich bewusst davon abheben willst. Sie weiß nicht, dass deine Kunden oft skeptisch gegenüber „Coaching“ sind und lieber „Beratung“ hören.

All diese Details machen den Unterschied zwischen einer Webseite, die konvertiert, und einer, die ignoriert wird.

AI kennt deine Zielgruppe nicht

Die vielleicht wichtigste Frage im Marketing lautet: Für wen ist das? Eine Webseite, die für alle spricht, spricht niemanden wirklich an. Effektive Kommunikation ist spezifisch. Sie adressiert konkrete Schmerzpunkte, spricht die Sprache der Zielgruppe, und zeigt Verständnis für ihre Situation.

Wenn du AI ohne detaillierte Zielgruppeninformationen fütterst, erhältst du generische Texte, die irgendwie passen könnten – aber niemanden wirklich abholen. „Wir helfen Ihnen, Ihre Ziele zu erreichen“ klingt nett, sagt aber nichts. „Du liegst nachts wach und fragst dich, wie du aus dieser Ehe herauskommst, ohne alles zu verlieren“ – das trifft ins Herz.

AI hat keine strategische Perspektive

Eine erfolgreiche Webseite ist Teil einer größeren Strategie. Sie ist eingebettet in einen Funnel, verbunden mit anderen Marketing-Kanälen, optimiert für spezifische Conversion-Ziele. Sie berücksichtigt, woher Besucher kommen, was sie bereits wissen, und wohin sie geführt werden sollen.

AI sieht nur die isolierte Aufgabe: „Schreibe einen Text für eine Landingpage.“ Sie sieht nicht das große Bild. Sie weiß nicht, dass diese Landingpage Traffic von einem YouTube-Video bekommt, in dem du bereits ein bestimmtes Problem angesprochen hast. Sie weiß nicht, dass Besucher nach dem Lesen der Seite einen Lead-Magneten herunterladen sollen, der sie weiter durch den Funnel führt.

AI reproduziert Durchschnitt

AI wurde mit dem trainiert, was existiert. Sie hat gelernt, was „normal“ ist. Wenn du sie bittest, eine Webseite zu erstellen, gibt sie dir eine durchschnittliche Webseite – den statistischen Mittelwert aller Webseiten, die sie gesehen hat.

Das Problem: Durchschnitt funktioniert nicht. Im Marketing gewinnt nicht der Durchschnitt, sondern das Außergewöhnliche. Die Webseite, die heraussticht. Der Text, der anders klingt. Das Angebot, das unvergleichbar ist.

Wenn alle AI nutzen, um durchschnittliche Webseiten zu erstellen, entsteht ein Ozean der Gleichförmigkeit. Und in diesem Ozean unterzugehen ist leicht.

Die Symptome des Problems

Vielleicht erkennst du einige dieser Symptome in deiner eigenen AI-generierten Webseite:

Generische Headlines

„Willkommen bei [Firmenname] – Ihr Partner für [Branche]“

„Wir helfen Ihnen, Ihre Ziele zu erreichen“

„Qualität, die überzeugt“

Diese Headlines sagen nichts. Sie könnten auf jeder Webseite stehen. Sie erzeugen kein Interesse, keine Emotion, keine Neugier. Ein Besucher liest sie und denkt: „Okay, und?“

Austauschbare Texte

Wenn du die Texte auf deiner Webseite liest und dabei deinen Firmennamen durch den eines Konkurrenten ersetzen könntest, ohne dass es auffällt – dann hast du ein Problem. AI-generierte Texte neigen dazu, so generisch zu sein, dass sie auf jedes Unternehmen der Branche passen könnten.

Fehlende emotionale Verbindung

Gute Webseiten-Texte erzeugen ein Gefühl beim Leser. Sie zeigen Verständnis, wecken Hoffnung, bauen Vertrauen auf. AI-generierte Texte sind oft sachlich korrekt, aber emotional flach. Sie informieren, aber sie berühren nicht.

Schwache Calls-to-Action

„Kontaktieren Sie uns“ – der langweiligste CTA der Welt. AI kennt diese Formulierung, weil sie überall vorkommt. Aber sie funktioniert nicht. Ein effektiver CTA ist spezifisch, nutzenorientiert und erzeugt Dringlichkeit. „Erzähl mir in 15 Minuten von deiner Situation – kostenlos und unverbindlich“ ist etwas völlig anderes.

SEO-Probleme

AI-generierte Inhalte können von Google erkannt werden – und Google mag sie nicht besonders. Nicht weil sie von AI stammen, sondern weil sie oft dünn, generisch und ohne echten Mehrwert sind. Webseiten voller AI-Content ranken schlecht, weil sie nichts Einzigartiges bieten.

Technische Schulden

Wenn AI Code generiert, ist dieser oft funktional, aber nicht optimal. Aufgeblähte Dateien, ineffiziente Strukturen, Accessibility-Probleme, schlechte Mobile-Optimierung – all das sind typische Symptome von AI-generiertem Code, der ohne menschliche Überprüfung übernommen wurde.

Inkonsistente Markenstimme

Wenn du verschiedene Teile deiner Webseite mit verschiedenen Prompts generierst, klingt jeder Teil anders. Die Homepage klingt professionell, die Über-uns-Seite plötzlich locker, die Produktbeschreibungen wieder technisch. Diese Inkonsistenz verwirrt Besucher und untergräbt das Vertrauen.

Die Lösung: Der strategische AI-Workflow

Die Lösung ist nicht, AI zu meiden. AI ist ein mächtiges Werkzeug, das dir enorme Zeitersparnisse bringen kann. Die Lösung ist, AI richtig einzusetzen – als Werkzeug in einem strategisch durchdachten Prozess, nicht als Ersatz für strategisches Denken.

Hier ist der Workflow, der funktioniert:

Schritt 1: Strategie vor Technologie

Bevor du auch nur einen Prompt tippst, musst du deine Hausaufgaben machen. Das bedeutet:

Zielgruppe definieren:

Wer genau soll diese Webseite besuchen? Nicht „Unternehmer“, sondern „Solo-Selbstständige im Bereich Beratung, 40-55 Jahre, die trotz Expertise Schwierigkeiten haben, Kunden zu gewinnen, weil sie Marketing als notwendiges Übel sehen.“

Je spezifischer, desto besser. Erstelle ein detailliertes Kundenprofil mit demografischen Daten, Schmerzpunkten, Wünschen, Ängsten, Einwänden, typischem Vokabular.

Ziele festlegen:

Was soll die Webseite konkret erreichen? „Mehr Kunden“ ist kein Ziel. „50 qualifizierte Leads pro Monat durch ein kostenloses Erstgespräch“ ist ein Ziel. „20% mehr Newsletter-Anmeldungen im Vergleich zum Vorquartal“ ist ein Ziel.

Klare Ziele ermöglichen klare Messung und klare Optimierung.

Positionierung klären:

Warum sollte jemand bei dir kaufen und nicht bei der Konkurrenz? Was ist dein Unique Value Proposition? Was kannst du, was andere nicht können? Oder was machst du anders, besser, spezieller?

Ohne klare Positionierung wird jede Webseite austauschbar.

Kundenreise verstehen:

Woher kommen deine Besucher? Was wissen sie bereits? In welcher Phase der Entscheidung befinden sie sich? Was brauchen sie als nächstes?

Eine Webseite für kalten Traffic (Besucher, die dich noch nicht kennen) muss völlig anders aufgebaut sein als eine für warmen Traffic (Besucher, die dich bereits von Social Media kennen).

Schritt 2: Struktur und Konzept entwickeln

Jetzt, mit der Strategie im Rücken, planst du die Struktur deiner Webseite:

Seitenarchitektur:

Welche Seiten brauchst du? In welcher Hierarchie? Wie navigieren Besucher durch die Seite?

Inhaltskonzept pro Seite:

Was soll auf jeder Seite stehen? Welche Botschaften? Welche Elemente (Testimonials, FAQ, Bilder)?

Conversion-Pfade:

Wie führst du Besucher zur gewünschten Aktion? Wo platzierst du CTAs? Welche Micro-Conversions gibt es auf dem Weg?

Visuelle Richtung:

Welche Stimmung soll das Design vermitteln? Welche Farben, Typografie, Bildsprache passen zu deiner Marke?

All das dokumentierst du, bevor du AI einschaltest.

Schritt 3: AI gezielt für Einzelaufgaben einsetzen

Jetzt kommt AI ins Spiel – aber nicht als Website-Generator, sondern als Assistent für spezifische Aufgaben.

Für Texte:

Statt „Schreibe mir eine Webseite“ gibst du der AI alle relevanten Informationen und bittest um einen spezifischen Text.

Ein effektiver Prompt könnte so aussehen:

„Schreibe eine Headline für eine Coaching-Landingpage. Die Zielgruppe sind Frauen zwischen 35-50, die gerade eine Scheidung durchmachen oder kürzlich geschieden wurden. Sie fühlen sich überfordert, haben Angst vor der Zukunft, und wissen nicht, wie sie finanziell und emotional einen Neuanfang schaffen sollen. Mein Coaching hilft ihnen, Klarheit zu gewinnen und einen konkreten Plan für die nächsten 12 Monate zu entwickeln. Die Headline soll empathisch sein, Hoffnung vermitteln, und neugierig auf mehr machen. Gib mir 10 Varianten.“

Das ist etwas völlig anderes als „Schreibe eine Coaching-Headline.“

Für Code:

Statt ganzer Webseiten lässt du AI spezifische Komponenten erstellen.

„Erstelle einen responsiven Header mit Logo links, Navigation in der Mitte (Home, Über mich, Angebot, Kontakt), und einem CTA-Button rechts. Mobile: Hamburger-Menü. Nutze HTML und Tailwind CSS.“

Für Design-Ideen:

AI-Bildgeneratoren können Moodboards, Farbpaletten oder Konzeptskizzen liefern – als Inspiration, nicht als fertiges Design.

Schritt 4: Menschliche Überarbeitung und Anpassung

Alles, was AI liefert, ist Rohmaterial. Deine Aufgabe ist es, dieses Rohmaterial zu veredeln.

Texte überarbeiten:

Lies jeden AI-generierten Text kritisch. Klingt er wie du? Spricht er deine Zielgruppe an? Ist er spezifisch genug? Meist wirst du 50-70% überarbeiten oder komplett neu schreiben. Das ist normal und richtig.

Code prüfen:

Teste jeden Code-Schnipsel. Funktioniert er? Ist er responsive? Lädt er schnell? Ist er accessible? Optimiere, wo nötig.

Konsistenz sicherstellen:

Gehe durch alle Texte und stelle sicher, dass sie eine einheitliche Stimme haben. Gleiche Terminologie, gleicher Ton, gleiche Persönlichkeit.

Schritt 5: Testen, Messen, Optimieren

Eine Webseite ist nie fertig. Sie ist ein lebendiges Werkzeug, das kontinuierlich verbessert wird.

Analytics einrichten:

Tracke, wie Besucher sich verhalten. Wo klicken sie? Wo springen sie ab? Wie lange bleiben sie?

A/B-Tests durchführen:

Teste verschiedene Headlines, CTAs, Layouts. Lass die Daten entscheiden, was funktioniert.

Feedback sammeln:

Frage echte Nutzer nach ihrer Meinung. Was ist verwirrend? Was fehlt? Was überzeugt?

Iterativ verbessern:

Basierend auf Daten und Feedback optimierst du kontinuierlich. Kleine Verbesserungen summieren sich zu großen Ergebnissen.

Praktische Tipps für den AI-gestützten Webseiten-Workflow

Erstelle ein Briefing-Dokument

Bevor du mit AI arbeitest, erstelle ein umfassendes Briefing-Dokument. Dieses enthält:

- Zielgruppenbeschreibung mit Schmerzpunkten und Wünschen

- Positionierung und USP

- Markenstimme und Tonalität (mit Beispielen)

- Kernbotschaften

- Keywords für SEO

- Verbotene Wörter oder Phrasen

- Beispiele von Webseiten, die dir gefallen

- Conversion-Ziele

Dieses Dokument ist dein Nordstern. Du kannst Teile davon in jeden Prompt einfügen, um konsistentere Ergebnisse zu erhalten.

Nutze System-Prompts

Wenn du mit ChatGPT oder Claude arbeitest, nutze System-Prompts oder Custom Instructions, um der AI eine dauerhafte Rolle zu geben:

„Du bist ein erfahrener Conversion-Copywriter, spezialisiert auf Webseiten für Coaches und Berater. Du schreibst in einem warmen, empathischen, aber auch klaren und direkten Ton. Du vermeidest Marketing-Floskeln und generische Formulierungen. Jeder Text, den du schreibst, adressiert spezifische Schmerzpunkte der Zielgruppe und führt zu einer klaren Handlungsaufforderung.“

Mit diesem Setup werden alle folgenden Outputs konsistenter und passender.

Arbeite in Schichten

Statt alles auf einmal zu generieren, arbeite in Schichten:

Schicht 1: Struktur

Lass AI eine Gliederung für jede Seite erstellen. Welche Abschnitte in welcher Reihenfolge?

Schicht 2: Kernbotschaften

Für jeden Abschnitt: Was ist die eine Hauptbotschaft?

Schicht 3: Ausformulierung

Jetzt erst die vollständigen Texte, Abschnitt für Abschnitt.

Schicht 4: Verfeinerung

Überarbeitung, Anpassung, Verbesserung.

Dieser Schichtansatz gibt dir mehr Kontrolle und verhindert, dass du mit einem Riesentext dastehst, der komplett unbrauchbar ist.

Generiere Varianten

Bitte AI immer um mehrere Varianten. „Gib mir 5 verschiedene Headlines“ ist besser als „Gib mir eine Headline.“ Du kannst dann auswählen, kombinieren, oder die beste Variante als Ausgangspunkt für weitere Iteration nutzen.

Nutze AI für Recherche

AI ist hervorragend für Vorarbeit. Lass sie:

- Häufige Fragen deiner Zielgruppe recherchieren

- Einwände sammeln, die Kunden typischerweise haben

- Wettbewerber-Messaging analysieren

- Keyword-Ideen generieren

- Strukturen erfolgreicher Landingpages skizzieren

Diese Recherche-Ergebnisse fließen dann in deine Strategie ein – die wiederum in bessere Prompts mündet.

Lerne Prompt Engineering

Die Qualität deiner Prompts bestimmt die Qualität der Outputs. Investiere Zeit, um effektive Prompts zu schreiben:

- Sei spezifisch über das gewünschte Ergebnis

- Gib Kontext über Zielgruppe und Zweck

- Definiere Format und Länge

- Nenne Beispiele für den gewünschten Stil

- Erkläre, was vermieden werden soll

- Bitte um mehrere Optionen

Ein guter Prompt kann mehrere Absätze lang sein. Das ist keine Verschwendung – es ist Investition in bessere Ergebnisse.

Wann AI wirklich glänzt

Trotz aller Einschränkungen gibt es Bereiche, in denen AI tatsächlich brillant ist:

Erste Entwürfe

Der leere Bildschirm ist der Feind jedes Creators. AI kann diesen Feind besiegen. Ein erster Entwurf, selbst wenn er mittelmäßig ist, gibt dir etwas zum Arbeiten. Überarbeiten ist einfacher als von Null beginnen.

Variationen

Du hast einen Text, der funktioniert, aber du brauchst eine kürzere Version für Mobile? Eine längere für einen Blogpost? Eine andere für Social Media? AI kann Variationen schnell erstellen.

Ideenfindung

Wenn du feststeckst, kann AI Brainstorming-Partner sein. „Gib mir 20 ungewöhnliche Ansätze für eine About-Page“ kann Ideen liefern, auf die du allein nicht gekommen wärst.

Technische Umsetzung

Code-Snippets, CSS-Anpassungen, JavaScript-Funktionen – AI kann technische Implementierung beschleunigen, besonders für Nicht-Entwickler.

Optimierung

„Wie kann ich diese Headline klarer formulieren?“ „Welche Einwände könnten Leser bei diesem Text haben?“ „Wie könnte ich diesen CTA überzeugender machen?“ AI kann als kritischer Sparringspartner dienen.

Übersetzung und Lokalisierung

Webseiten in andere Sprachen zu übertragen ist eine Stärke von AI – vorausgesetzt, ein Muttersprachler prüft das Ergebnis.

Die richtige Erwartungshaltung

Lass mich realistisch sein: AI wird dir wahrscheinlich 50-70% der Arbeit abnehmen. Nicht 100%. Wenn du vorher 40 Stunden für eine Webseite gebraucht hast, wirst du mit AI vielleicht 15-20 Stunden brauchen. Das ist eine enorme Ersparnis. Aber es ist nicht „5 Minuten und fertig.“

Die Zeitersparnis kommt aus:

- Schnellere erste Entwürfe

- Weniger Recherche-Aufwand

- Automatisierte technische Umsetzung

- Schnellere Iteration

Die verbleibende Zeit geht in:

- Strategische Vorarbeit

- Prompterstellung und -verfeinerung

- Überarbeitung und Anpassung

- Testing und Optimierung

Diese verbleibende Zeit ist nicht verschwendet. Sie ist der Unterschied zwischen einer mittelmäßigen Webseite und einer, die tatsächlich funktioniert.

Ein realistisches Beispiel

Lass mich dir zeigen, wie ein AI-gestützter Webseiten-Prozess aussehen könnte:

Tag 1: Strategie (4 Stunden)

- Zielgruppen-Workshop (allein oder mit Kunden)

- Positionierung definieren

- Ziele festlegen

- Wettbewerber analysieren

Tag 2: Konzept (3 Stunden)

- Seitenarchitektur entwickeln

- Inhaltskonzept pro Seite

- Wireframes skizzieren

Tag 3: Content-Generierung (4 Stunden)

- Briefing-Dokument erstellen

- AI-Prompts für jede Seite entwickeln

- Erste Entwürfe generieren

Tag 4: Überarbeitung (5 Stunden)

- Alle Texte durchgehen und überarbeiten

- Konsistenz sicherstellen

- CTAs optimieren

Tag 5: Design und Umsetzung (6 Stunden)

- Template auswählen und anpassen

- Texte einpflegen

- Bilder auswählen und optimieren

- Responsive Testing

Tag 6: Feinschliff und Launch (3 Stunden)

- Finale Überprüfung

- SEO-Basics

- Analytics einrichten

- Launch

Gesamt: ca. 25 Stunden

Das ist realistisch für eine professionelle, strategisch durchdachte Webseite. Nicht 5 Minuten. Aber auch nicht die 60-80 Stunden, die es ohne AI dauern könnte.

Fazit: AI als Werkzeug, nicht als Wunderwaffe

Das größte Problem beim Webseiten bauen mit AI ist die Erwartung, dass AI das strategische Denken ersetzen kann. Sie kann es nicht. Keine Technologie der Welt kann ersetzen, dass du dein Business, deine Zielgruppe und deine Ziele verstehst.

Aber wenn du diese strategische Vorarbeit leistest, wird AI zu einem unglaublich mächtigen Werkzeug. Sie beschleunigt deine Arbeit, inspiriert neue Ideen, und nimmt dir repetitive Aufgaben ab. Sie macht dich nicht überflüssig – sie macht dich effektiver.

Die erfolgreichsten Menschen, die AI für Webseiten nutzen, sind nicht diejenigen, die den besten AI-Website-Builder gefunden haben. Es sind diejenigen, die verstanden haben, dass AI nur so gut ist wie die Anweisungen, die sie bekommt. Und gute Anweisungen erfordern strategisches Denken.

Also hör auf, nach dem magischen Prompt zu suchen, der alles löst. Investiere stattdessen in deine Strategie. Verstehe deine Zielgruppe in der Tiefe. Definiere deine Positionierung messerscharf. Setze klare Ziele. Und dann – erst dann – nutze AI, um diese Strategie effizient umzusetzen.

Das ist der Unterschied zwischen einer AI-generierten Webseite, die niemanden interessiert, und einer AI-unterstützten Webseite, die dein Business transformiert.

Die Wahl liegt bei dir.