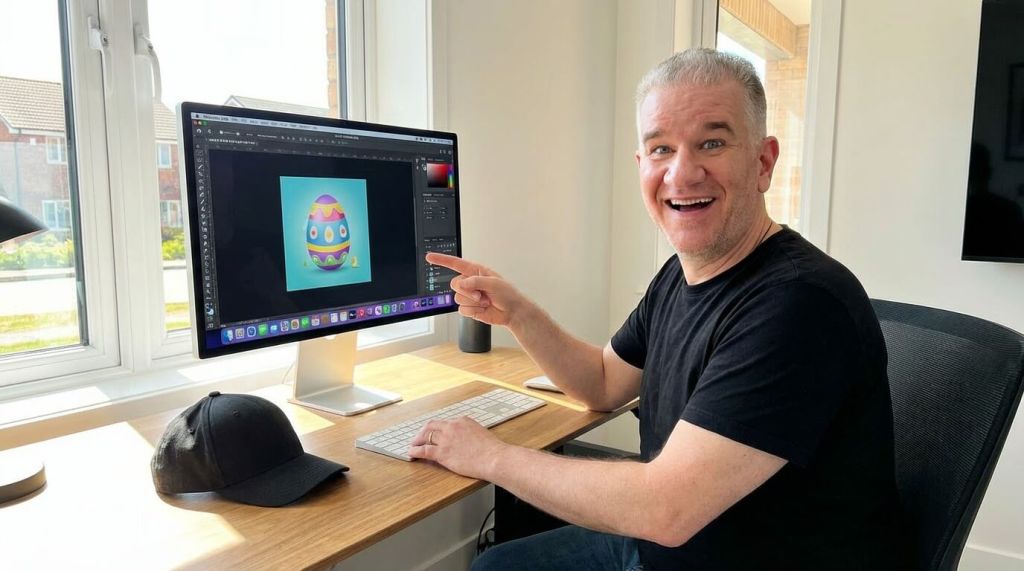

Ein Fachartikel über die Kernwerkzeuge, die jeder Kreative beherrschen sollte – von grundlegend bis unverzichtbar

Adobe Photoshop existiert seit 1990 und hat in über drei Jahrzehnten eine schier unüberschaubare Anzahl an Features, Werkzeugen und Funktionen angesammelt. Die aktuelle Version (Photoshop 2024/2025) bietet Hunderte von Optionen, Tausende von möglichen Workflows und nahezu unbegrenzte Kombinationsmöglichkeiten.

Für Einsteiger: überwältigend. Für Profis: oft zu viel des Guten.

Die Wahrheit ist: In der Praxis lassen sich die allermeisten professionellen Bildbearbeitungsaufgaben mit einem überschaubaren Kernset an Funktionen bewältigen. Diese Funktionen sind nicht unbedingt die flashigsten oder neuesten – aber sie sind die Grundpfeiler jedes ernsthaften Photoshop-Workflows.

Nach 15 Jahren als Imaging Consultant für Agenturen, Studios und Einzelkünstler habe ich festgestellt: Die besten Photoshop-Anwender sind nicht die, die jedes Feature kennen. Es sind die, die die fundamentalen Funktionen in- und auswendig beherrschen.

Dieser Artikel destilliert die Essenz von Photoshop auf die 10 Funktionen, die den größten Unterschied machen – erklärt nicht nur was sie tun, sondern warum sie unverzichtbar sind und wie sie zusammenwirken.

1. Ebenen (Layers): Das Fundament zerstörungsfreien Arbeitens

Was es ist

Das Ebenensystem ist Photoshops grundlegendes Organisationsprinzip. Jede Ebene ist ein separates, transparentes „Blatt“, auf dem Bildelemente, Effekte oder Anpassungen liegen. Sie stapeln sich übereinander wie Folien auf einem Overhead-Projektor.

Warum es unverzichtbar ist

Ohne Ebenen gibt es kein professionelles Photoshop.

Vor der Einführung von Ebenen in Photoshop 3.0 im Jahr 1994 war jede Änderung permanent. Ein Fehler? Undo oder neu anfangen. Ebenen ermöglichen:

- Zerstörungsfreies Arbeiten: Originale bleiben intakt

- Flexibilität: Jederzeit Änderungen möglich

- Komplexität: Hunderte Elemente organisiert in einem Dokument

- Kollaboration: Klar strukturierte Dateien für Teams

Kernfunktionen, die man kennen muss

Ebenentypen:

- Pixelebenen (normale Bildebenen)

- Anpassungsebenen (Farbkorrekturen)

- Textebenen

- Formebenen

- Smart Objects (siehe Punkt 8)

Organisationstools:

- Ebenengruppen (Ordner-Struktur)

- Farbcodierung

- Ebenenfilter (zum schnellen Finden)

- Ebenenkomposition (verschiedene Versionen speichern)

Ebenensteuerung:

- Deckkraft (Opacity): Transparenz der gesamten Ebene (0-100%)

- Fläche (Fill): Transparenz nur des Inhalts, nicht der Effekte

- Sperren (Lock): Transparenz, Position, Pixel sperren

Praxistipp

Benennungskonvention ist alles. Profis benennen Ebenen systematisch:

BG_landscape(Background)ADJ_color_grade(Adjustment)RTH_skin_smooth(Retouch)TXT_headline_final(Text)

Bei 50+ Ebenen ist das der Unterschied zwischen Workflow und Chaos.

Typischer Fehler

Anfänger arbeiten oft auf einer einzigen Ebene (der Hintergrundebene) und fragen sich, warum sie später nichts mehr ändern können. Grundregel: Das Original bleibt immer unangetastet auf einer gesperrten Ebene ganz unten.

2. Maskierung: Die Kunst des selektiven Sichtbarmachens

Was es ist

Masken kontrollieren die Sichtbarkeit von Ebeneninhalten, ohne Pixel zu löschen. Schwarz verbirgt, Weiß zeigt, Graustufen ergeben Transparenz. Es ist wie ein Schablonen-System, das non-destruktiv ist.

Warum es unverzichtbar ist

Maskierung ist der Unterschied zwischen „Photoshop bedienen“ und „Photoshop beherrschen“.

Ohne Maskierung:

- Löschen ist permanent

- Weiche Übergänge sind schwierig

- Komplexe Kompositionen kaum möglich

- Änderungen bedeuten Neuanfang

Mit Maskierung:

- Alles ist reversibel

- Präzise Kontrolle über Sichtbarkeit

- Nahtlose Übergänge möglich

- Beliebig anpassbar

Typen von Masken

1. Ebenenmasken (Layer Masks)

- Die wichtigste Maskenart

- Kontrolliert Sichtbarkeit der gesamten Ebene

- Editierbar mit jedem Mal- oder Auswahlwerkzeug

2. Vektormasken

- Pfadbasierte Masken

- Skalierbar ohne Qualitätsverlust

- Ideal für scharfe, geometrische Formen

3. Schnittmasken (Clipping Masks)

- Eine Ebene nutzt die Transparenz der darunter liegenden

- Perfekt für Texturen in Text

- Schnelle, nicht-destruktive Gruppierung

4. Alphakanäle

- Gespeicherte Auswahlen

- Wiederverwendbar

- Basis für komplexe Selektionen

Masken-Workflow-Prinzip

Der professionelle Ansatz:

- Erstelle die Auswahl (mit beliebigem Werkzeug)

- Konvertiere zu Maske (Klick auf Masken-Icon)

- Verfeinere die Maske (Pinsel, Gradients, Filter)

- Nutze Properties-Panel für globale Anpassungen (Density, Feather)

Praxistipp: Die Quickmask-Technik

Shift + Klick auf Masken-Thumbnail = Maske temporär deaktivieren

Alt + Klick auf Masken-Thumbnail = Maske isoliert anzeigen

Q-Taste = Quickmask-Modus (Maske als rote Überlagerung sehen und malen)

Diese Shortcuts sparen Stunden an Fummelarbeit.

Fortgeschrittene Technik: Luminanzmasken

Masken basierend auf Helligkeitswerten des Bildes. Ermöglichen:

- Selektive Farbkorrekturen nur in Highlights oder Schatten

- Natürlich aussehende Anpassungen

- Präzise Kontrolle über Tonwertbereiche

Erstellen: Select > Color Range > Highlights/Midtones/Shadows

3. Auswahl-Werkzeuge: Präzision in der Selektion

Was es ist

Auswahl-Werkzeuge definieren, welcher Bereich eines Bildes bearbeitet werden soll. Die Auswahl ist die Grundlage für Masken, Isolierung von Objekten und zielgerichtete Anpassungen.

Die wichtigsten Auswahl-Werkzeuge 2024/2025

1. Objektauswahl-Werkzeug (Object Selection Tool)

- KI-basiert (Adobe Sensei)

- Erkennt automatisch Objekte

- Extrem schnell für klare Motive

- Shortcut: W (dann in Optionsleiste umschalten)

2. Schnellauswahl (Quick Selection)

- Pinselbasiert

- „Malt“ Auswahl auf Grundlage von Farbähnlichkeit

- Gut für organische Formen

- Shortcut: W

3. Zauberstab (Magic Wand)

- Selektiert nach Farbtoleranz

- Klassisch, aber oft zu grob

- Gut für Hintergründe mit einheitlicher Farbe

- Shortcut: W (Shift+W zum Durchschalten)

4. Lasso-Werkzeuge

- Freihand-Lasso: für schnelle, ungenaue Auswahlen

- Polygon-Lasso: für gerade Kanten

- Magnetisches Lasso: folgt Kanten automatisch

- Shortcut: L

5. Auswahlrechteck/Ellipse

- Für geometrische Auswahlen

- Mit Shift = perfektes Quadrat/Kreis

- Shortcut: M

Die Revolution: „Motiv auswählen“ (Select Subject)

Seit 2018, massiv verbessert in den Folgeversionen:

Select > Subject oder Button in der Optionsleiste

KI analysiert das Bild und selektiert automatisch das Hauptmotiv. In vielen Standardsituationen – besonders bei guter Beleuchtung und klaren Konturen – liefert diese Funktion bereits sehr gute Ergebnisse, die nur minimale Nacharbeit erfordern.

Bei komplexen Motiven (Haare, Fell, transparente Materialien, Gegenlicht) ist allerdings häufig noch manuelle Nachbearbeitung nötig.

Kombiniert mit „Auswählen und maskieren“ (Select and Mask) ist das ein sehr effizienter Workflow für Freisteller.

Auswahl verfeinern: Select and Mask

Der Game-Changer für schwierige Auswahlen (Haare, Fell, transparente Objekte):

Select > Select and Mask oder Alt + Ctrl/Cmd + R

Hier können Sie:

- Kanten glätten (Smooth)

- Weiche Kante erstellen (Feather)

- Kontrast erhöhen (Contrast)

- Kante verschieben (Shift Edge)

- Refine Edge Brush Tool: Für Haare und feine Details – malen Sie über problematische Bereiche

Praxistipp: Auswahl-Mathematik

Auswahlen sind kombinierbar:

- Neue Auswahl: Normale Nutzung

- Zur Auswahl hinzufügen: Shift + Werkzeug

- Von Auswahl abziehen: Alt + Werkzeug

- Schnittmenge: Shift + Alt + Werkzeug

Beispiel: Rechteck über gesamten Bereich, dann Alt + Ellipse um Loch auszusparen = Ring.

Typischer Anfängerfehler

Zu perfektionistisch bei der ersten Auswahl sein. Besser: Grobe Auswahl erstellen, in Maske konvertieren, dann verfeinern. Masken sind editierbar, Auswahlen nur bedingt.

4. Anpassungsebenen: Zerstörungsfreie Farbkorrektur

Was es ist

Anpassungsebenen sind spezielle Ebenen, die Farbkorrekturen, Tonwertanpassungen und andere Bildveränderungen enthalten – ohne das Original zu verändern. Sie können jederzeit angepasst, maskiert oder gelöscht werden.

Warum das wichtig ist

Direkte Anpassungen (Image > Adjustments) verändern Pixel permanent.

Anpassungsebenen bleiben editierbar und non-destruktiv.

Das ist wie der Unterschied zwischen Tinte und Bleistift.

Die 7 wichtigsten Anpassungsebenen

1. Curves (Gradationskurven)

- Eines der mächtigsten Werkzeuge für Tonwert- und Farbkorrektur

- Präzise Kontrolle über jeden Tonwertbereich

- RGB-Kanäle einzeln steuerbar

- Nutzung: Gehört zu den wichtigsten Werkzeugen professioneller Farbkorrektur

2. Levels (Tonwertkorrektur)

- Einfacher als Curves, aber weniger flexibel

- Perfekt für Weiß-/Schwarzpunkt-Korrektur

- Schnelle Kontrast-Anpassungen

- Nutzung: Basis-Korrekturen, Histogramm-Optimierung

3. Hue/Saturation (Farbton/Sättigung)

- Globale oder selektive Farbanpassung

- Einzelne Farbbereiche gezielt ändern

- Schnelle Farbverschiebungen

- Nutzung: Kreative Farbänderungen, Sättigung-Boosts

4. Color Balance (Farbbalance)

- Farbstiche korrigieren

- Getrennte Kontrolle über Shadows/Midtones/Highlights

- Intuitiver als Curves für Farbtemperatur

- Nutzung: Weiß-Abgleich, Stimmungsanpassungen

5. Black & White

- Intelligente Schwarzweiß-Konvertierung

- Kontrolle über Helligkeitswerte einzelner Farben

- Tinting-Optionen

- Nutzung: Hochwertige Schwarzweiß-Umwandlung

6. Selective Color (Selektive Farbkorrektur)

- Präzise CMYK-basierte Farbanpassung

- Sehr feine Kontrolle

- Favorit im High-End-Retouching

- Nutzung: Subtile, professionelle Farbkorrekturen

7. Vibrance (Dynamik)

- Intelligentere Sättigung

- Schützt Hauttöne

- Verhindert Übersättigung

- Nutzung: Natürliche Sättigung-Erhöhung

Workflow-Prinzip: Der Adjustment-Layer-Stack

Ein typischer professioneller Korrektur-Stack (von unten nach oben):

- Basis-Tonwert (Levels/Curves) – Weiß-/Schwarzpunkt

- Kontrast (Curves)

- Farbbalance/Grading (Color Balance, Curves)

- Selektive Anpassungen (Hue/Saturation, Selective Color)

- Finale Feinabstimmung (Vibrance, Curves)

Jede Ebene hat eine Maske für selektive Anwendung.

Praxistipp: Properties-Panel nutzen

Doppelklick auf Anpassungsebene öffnet Properties-Panel. Hier können Sie:

- Settings jederzeit ändern

- Masken direkt editieren

- Presets speichern

- Clip to Layer darunter (Clipping-Mask)

Fortgeschrittene Technik: Curves für Farbgrading

So nutzen viele Profis Curves für cinematic Looks:

- Erstelle Curves-Anpassungsebene

- Wechsle zu einzelnen Farbkanälen (RGB-Dropdown)

- Blue Channel: Lift Shadows (hebt Kurve links), senke Highlights leicht = Orange & Teal Look

- Red/Green: Feintuning

Dieser Look ist ein weit verbreiteter Color-Grading-Ansatz im Mainstream-Kino und in der kommerziellen Fotografie.

5. Retusche-Werkzeuge: Healing Brush, Clone Stamp & Co.

Was es ist

Retusche-Werkzeuge entfernen unerwünschte Elemente, korrigieren Hautunreinheiten und reparieren beschädigte Bildbereiche durch Klonen oder intelligentes Sampling.

Die Werkzeug-Familie

1. Spot Healing Brush (Bereichsreparatur-Pinsel)

- Shortcut: J

- Ein-Klick-Lösung für kleine Makel

- KI-basiert: Photoshop findet automatisch passende Textur

- Nutzung: Hautunreinheiten, kleine Störungen, Sensor-Flecken

Modi:

- Content-Aware (inhaltsbasiert): Beste Ergebnisse, KI-gestützt

- Create Texture: Erzeugt Textur aus Umgebung

- Proximity Match: Nutzt direkt angrenzende Pixel

2. Healing Brush (Reparatur-Pinsel)

- Shortcut: J (Shift+J zum Wechseln)

- Wie Spot Healing, aber manuelle Sample-Punkt-Auswahl

- Passt Textur, Farbe und Tonwert an Umgebung an

- Nutzung: Größere Retuschen mit spezifischer Quelle

Workflow:

- Alt + Klick = Sample-Punkt setzen

- Malen über Zielbereich

- Photoshop matched automatisch Helligkeit/Farbe

3. Clone Stamp (Kopierstempel)

- Shortcut: S

- Kopiert Pixel exakt ohne Angleichung

- Volle Kontrolle, aber keine automatische Anpassung

- Nutzung: Präzise Duplikationen, Pattern-Wiederholung

Optionen:

- Aligned: Sample-Punkt bewegt sich mit Cursor

- Sample: Current Layer, Current & Below, All Layers

4. Patch Tool (Ausbessern-Werkzeug)

- Shortcut: J (durchschalten)

- Selektionsbasiert

- Zieht Auswahl auf Quelle oder umgekehrt

- Nutzung: Größere Bereiche, wo Pinsel zu langsam ist

Modi:

- Normal: Ziehe auf Quelle

- Content-Aware: KI findet beste Quelle

- Destination: Umgekehrte Richtung

5. Content-Aware Fill (Inhaltsbasierte Füllung)

- Nicht direkt ein Werkzeug, sondern Feature

- Edit > Content-Aware Fill oder Shift + Delete > Content-Aware

- KI analysiert Umgebung und füllt Auswahl

- Nutzung: Objekte entfernen, Bild erweitern

Seit 2019: Dedizierter Workspace:

Edit > Content-Aware Fill...- Zeigt, welche Bereiche als Sample dienen

- Ausschließbare Bereiche

- Preview verschiedener Füll-Optionen

Retusche-Best-Practices

1. Immer auf separater Ebene arbeiten

- Erstelle leere Ebene über Original

- Aktiviere „Sample All Layers“ in Tool-Optionen

- Retuschen bleiben editierbar/löschbar

2. Bei Hautretusche: Frequenztrennung

Fortgeschrittene Technik, aber Industry-Standard:

- Trennt Textur von Farbe/Ton

- Erlaubt Hautglättung ohne Texturverlust

- Verhindert „Plastik-Haut“-Look

3. Non-destruktiv durch Smart Objects

- Konvertiere Ebene zu Smart Object

- Filter werden als Smart Filter angewendet

- Jederzeit editierbar

Praxistipp: Pinsel-Shortcuts

Bei aktivem Retusche-Tool:

- [ / ] = Pinselgröße verringern/vergrößern

- Shift + [ / ] = Härte verringern/vergrößern

- Rechtsklick = Pinsel-Settings-Menu

Typischer Fehler

Zu aggressive Retusche. Profis retouchieren in mehreren, subtilen Durchgängen mit reduzierter Ebenen-Deckkraft (60-80%), nicht in einem Durchgang mit 100%.

6. Transformationen: Größe, Form und Perspektive

Was es ist

Transform-Funktionen ändern die geometrischen Eigenschaften von Ebenen: Größe, Rotation, Verzerrung, Perspektive, Warp.

Basis-Transformationen

Free Transform (Frei transformieren)

- Shortcut: Ctrl/Cmd + T

- Zentrale Funktion für alle geometrischen Änderungen

Im Transform-Modus:

- Ziehen an Ecken: Größe ändern

- Shift + Ziehen: Proportional skalieren

- Alt + Ziehen: Von Zentrum skalieren

- Shift + Alt + Ziehen: Proportional von Zentrum

- Außerhalb Bounding Box: Rotieren

- Shift + Rotieren: In 15°-Schritten

- Ctrl/Cmd + Ziehen an Eckpunkt: Freie Verzerrung

- Enter: Bestätigen

- Esc: Abbrechen

Spezialisierte Transform-Modi

1. Perspective (Perspektive)

Edit > Transform > Perspective- Ändert Perspektive symmetrisch

- Nutzung: Gebäude gerade richten, Objekte in perspektivischen Raum einfügen

2. Distort (Verzerren)

Edit > Transform > Distort- Freie Verzerrung aller Eckpunkte unabhängig

- Nutzung: Objekte an perspektivische Flächen anpassen

3. Warp (Verkrümmen)

Edit > Transform > Warp- Gitter-basierte, organische Verzerrung

- Nutzung: Kleidungsfalten simulieren, Text auf gebogene Oberflächen

Im Warp-Modus:

- 9-Punkt-Gitter standardmäßig

- Ziehe an Gitterpunkten oder Kurven

- Dropdown für Presets (Bogen, Fisch, etc.)

- Shift + Alt + Ziehen = Symmetrisch verzerren

4. Puppet Warp (Formgitter)

Edit > Puppet Warp- Setzt Pins auf Bild, Verformung um diese Punkte

- Nutzung: Körperhaltung ändern, Gliedmaßen bewegen

Content-Aware Scale

Edit > Content-Aware Scale oder Alt + Shift + Ctrl/Cmd + C

Intelligente Skalierung, die wichtige Bildbereiche schützt:

- Hintergründe werden komprimiert

- Personen/Objekte bleiben proportional

- Nutzung: Bilder an andere Seitenverhältnisse anpassen ohne Cropping

Tipp: Erstelle Alpha-Kanal für geschützte Bereiche (Protect Skin Tones allein reicht oft nicht)

Perspektivische Verzerrung

Edit > Perspective Warp

Zwei-Phasen-System:

- Layout: Definiere perspektivische Ebenen (zeichne Quads)

- Warp: Ziehe an Eckpunkten, um Perspektive zu ändern

Nutzung:

- Architektur-Korrektur

- Buchcover in Perspektive legen

- Objekte in 3D-Raum einfügen

Praxistipp: Transform-While-Moving

Beim Verschieben von Ebenen (Move Tool, V):

- Ctrl/Cmd + T SOFORT drücken = Transform-Modus während Movement

- Spart einen Schritt

Smart Objects und Transformationen

Kritisch wichtig:

Normale Ebenen verlieren Qualität bei wiederholtem Skalieren (besonders Hoch-Runter-Hoch).

Lösung: Smart Objects

Layer > Smart Objects > Convert to Smart Object- Transformationen sind non-destruktiv

- Beliebig oft skalierbar ohne Qualitätsverlust

- Speichert Original-Auflösung

Workflow: Bei allem, was transformiert wird – erst in Smart Object konvertieren.

7. Filter: Von subtil bis surreal

Was es ist

Filter sind Algorithmen, die Pixel mathematisch manipulieren – von realistischen Effekten wie Schärfung bis zu künstlerischen Verzerrungen.

Die essentiellen Filter

1. Blur (Weichzeichner)

Gaussian Blur

- Standard-Weichzeichner

- Gleichmäßig, vorhersagbar

- Nutzung: Hintergründe entsättigen, Hautglättung (mit Maske), sanfte Übergänge

Lens Blur

- Simuliert Kamera-Unschärfe (Bokeh)

- Depth-Map-basiert

- Nutzung: Künstliche Tiefenschärfe, Bokeh-Effekte

Motion Blur (Bewegungsunschärfe)

- Richtungsbasierte Unschärfe

- Nutzung: Bewegung simulieren, Speed-Effekt

Field Blur / Tilt-Shift / Iris Blur

- Teil des Blur Gallery (Filter > Blur Gallery)

- On-Canvas-Kontrolle

- Mehrere Blur-Punkte, Gradients

- Nutzung: Realistische Schärfentiefe-Simulation

2. Sharpen (Scharfzeichnen)

Unsharp Mask (Unscharf maskieren)

- Klassischer Schärfungsfilter

- Drei Parameter: Amount, Radius, Threshold

- Nutzung: Grundlegende Bildschärfung

Smart Sharpen

- Fortgeschrittener als Unsharp Mask

- Reduziert Halo-Artefakte

- Shadow/Highlight-Schärfung separat

- Nutzung: Finale Bildschärfung vor Export

Typisches Sharpening-Workflow:

- Smart Object erstellen

- Smart Sharpen anwenden (Amount: 80-150%, Radius: 0.5-1.5px)

- Falls zu stark: Ebenen-Deckkraft reduzieren oder Masken nutzen

3. Noise (Rauschen)

Add Noise

- Fügt Körnung hinzu

- Nutzung: Film-Look, zu glatte Digital-Bilder organischer machen

Reduce Noise

- Entfernt Rauschen

- Preserves Details-Option

- Nutzung: High-ISO-Fotos aufräumen

4. Neural Filters (KI-basiert, seit 2020)

Photoshops KI-Feature-Set, ständig erweitert:

Skin Smoothing

- Automatische Hautglättung

- Stärke-Control

- Oft zu aggressiv – subtil einsetzen

Style Transfer

- Übertrage Stil eines Bildes auf anderes

- Künstlerische Effekte

Colorize (Kolorierung)

- Schwarzweiß-Bilder automatisch kolorieren

- Erstaunlich gut für historische Fotos

Super Zoom (JPEG-Artefaktentfernung)

- Verbessert Details beim Upscaling

- Nützlich für niedrig-aufgelöste Quellen

⚠️ Wichtig: Neural Filters sind cloud-basiert und können je nach Hardware und Internetverbindung unterschiedlich performant sein. Ergebnisse sollten in professionellen Workflows immer manuell überprüft werden.

Filter-Best-Practices

1. Smart Filters nutzen

Bei Smart Objects angewendete Filter werden zu „Smart Filters“:

- Editierbar (Doppelklick)

- Ein/ausschaltbar

- Maskierbar

- Non-destruktiv

Workflow:

- Ebene zu Smart Object konvertieren

- Filter anwenden

- Filter erscheint als Unterebene

- Maske steuert, wo Filter wirkt

2. Filter-Maskierung

Nach Smart-Filter-Anwendung:

- Klicke auf weiße Filter-Maske

- Male mit schwarzem Pinsel, wo Filter NICHT wirken soll

- Beispiel: Schärfung nur auf Hauptmotiv, nicht auf Hintergrund

3. Fade Command

Direkt nach Filter-Anwendung (non-smart):

Edit > Fade [Filtername] oder Shift + Ctrl/Cmd + F

Erlaubt:

- Deckkraft reduzieren

- Blend Mode ändern (oft übersehen, sehr mächtig)

Beispiel: Sharpen mit 100% anwenden, dann Fade auf Luminosity-Modus = Schärfung nur auf Helligkeit, keine Farbverschiebungen

8. Smart Objects: Die unterschätzte Superkraft

Was es ist

Ein Smart Object ist ein Container, der Ebenen oder Dateien einbettet und deren Originaldaten bewahrt. Transformationen, Filter und Anpassungen werden non-destruktiv angewendet.

Warum es transformativ ist

Smart Objects lösen fundamentale Photoshop-Probleme:

Problem 1: Qualitätsverlust bei Skalierung

- Normale Ebene bei 50% skalieren, dann wieder auf 200% = Qualitätsverlust

- Smart Object: Original-Daten bleiben erhalten

Problem 2: Nicht-editierbare Filter

- Normale Filter sind permanent

- Smart Filters: jederzeit editierbar

Problem 3: Wiederholte Änderungen

- Mehrere Dateien mit demselben Logo – Logo ändert sich

- Normale Ebene: Alle Dateien einzeln ändern

- Linked Smart Object: Einmal ändern, überall aktualisiert

Smart Object-Typen

1. Embedded Smart Object

- Standard-Typ

- Daten in PSD-Datei eingebettet

- Jede Instanz unabhängig

2. Linked Smart Object

- Verlinkt zu externer Datei

- Mehrere Instanzen synchronisiert

- Änderung im Original = alle Instanzen aktualisiert

- Nutzung: Templates, wiederkehrende Elemente

Wann Smart Objects nutzen

Immer bei:

- Vektordaten (Illustrator, Logos)

- Elementen, die skaliert werden

- Filter-Anwendung (wenn Editierbarkeit gewünscht)

- Datei-Platzierung (Place Embedded/Linked)

Manchmal bei:

- Ebenen-Gruppen, die zusammen behandelt werden

- RAW-Dateien (als Camera RAW Smart Object)

Nie bei:

- Retuschen (Healing Brush funktioniert nicht auf Smart Objects direkt)

- Ebenen, die gemalt/geklont werden müssen

Smart Object-Workflow

Erstellen:

Layer > Smart Objects > Convert to Smart Object- Oder: Rechtsklick auf Ebene > Convert to Smart Object

Bearbeiten:

- Doppelklick auf Smart Object-Thumbnail

- Öffnet in separatem Fenster/Tab

- Änderungen vornehmen

- Speichern (Ctrl/Cmd + S) = aktualisiert automatisch im Haupt-Dokument

Rasterisieren (wenn nötig):

Layer > Smart Objects > Rasterize- Konvertiert zurück zu normaler Ebene

- ⚠️ Verliert Smart-Object-Vorteile

Praxistipp: Camera RAW als Smart Object

RAW-Dateien aus Lightroom/Camera RAW:

File > Open as Smart Object

Vorteile:

- Camera RAW-Einstellungen bleiben editierbar

- Doppelklick auf Ebene = zurück zu Camera RAW

- Non-destruktiver RAW-Workflow in Photoshop

Workflow:

- Öffne RAW als Smart Object

- Bearbeite in Photoshop (Retuschen, Compositing)

- Wenn RAW-Anpassung nötig: Doppelklick, zurück zu Camera RAW

- Speichern = Update im Photoshop-Dokument

Fortgeschrittene Technik: Smart Object-Stapel

Layer > Smart Objects > Stack Mode

Mehrere Ebenen in Smart Object:

- Mean: Durchschnitt aller Ebenen (Tourist-Entfernung!)

- Median: Mittlerer Wert

- Maximum/Minimum

Nutzung: Touristen aus Serie von Fotos entfernen, Langzeitbelichtung simulieren

9. Mischmodi (Blend Modes): Die Mathematik hinter der Magie

Was es ist

Blend Modes bestimmen, wie Pixel einer Ebene mit darunterliegenden Ebenen mathematisch kombiniert werden. 27 Modi, gruppiert nach Funktion.

Warum es wichtig ist

Blend Modes ermöglichen Effekte, die sonst Stunden komplexer Maskenarbeit erfordern würden. Sie sind die Grundlage von:

- Non-destruktivem Dodging & Burning

- Color Grading

- Texture Overlays

- Komplexen Kompositionen

Die wichtigsten Blend Mode-Gruppen

1. Darken-Gruppe (Abdunkeln)

Darken

- Zeigt dunklere Pixel

- Nutzung: Himmel-Replacements, dunkle Elemente einfügen

Multiply (Multiplizieren)

- Multipliziert Farben (wird immer dunkler)

- Weiß = unsichtbar

- Nutzung: Schatten erstellen, Belichtung reduzieren, Texture Overlays

Color Burn

- Extremere Abdunklung mit gesättigten Farben

- Nutzung: Dramatische Effekte

2. Lighten-Gruppe (Aufhellen)

Lighten

- Zeigt hellere Pixel

- Nutzung: Lichteffekte kombinieren

Screen (Negativ multiplizieren)

- Gegenteil von Multiply

- Schwarz = unsichtbar

- Nutzung: Lichteffekte, Aufhellungen, Lens Flares

Color Dodge

- Extreme Aufhellung

- Nutzung: Glüh-Effekte, Highlights verstärken

3. Contrast-Gruppe (Kontrast)

Overlay

- Kombiniert Multiply (dunkle Bereiche) und Screen (helle Bereiche)

- 50% Grau = unsichtbar

- Nutzung: Textur-Overlays, Contrast-Boost

Soft Light

- Subtilere Version von Overlay

- Nutzung: Dodging & Burning, sanfte Kontrast-Erhöhung

Hard Light

- Aggressivere Version von Overlay

- Nutzung: Starke Kontrast-Effekte

4. Vergleichs-Gruppe

Difference

- Zeigt Unterschied zwischen Ebenen

- Nutzung: Ebenen präzise ausrichten (Unterschied = komplett schwarz bei perfekter Ausrichtung)

5. Color-Gruppe

Hue (Farbton)

- Übernimmt nur Farbton, nicht Sättigung/Helligkeit

Saturation (Sättigung)

- Übernimmt nur Sättigung

Color (Farbe)

- Übernimmt Farbton UND Sättigung, nicht Helligkeit

- Nutzung: Kolorierung, Color Grading ohne Helligkeitsänderung

Luminosity (Luminanz)

- Übernimmt nur Helligkeit, nicht Farbe

- Nutzung: Schärfung ohne Farbfringing, Helligkeit-Anpassungen

Praxistipp: Dodge & Burn mit Soft Light

Professionelles Non-Destruktives Dodging & Burning:

- Neue Ebene erstellen

- Edit > Fill > 50% Gray

- Blend Mode auf Soft Light setzen

- Mit weißem Pinsel (niedrige Opacity, 10-20%) aufhellen

- Mit schwarzem Pinsel abdunkeln

Ergebnis: Vollständig editierbare, subtile Kontrastanpassungen

Typischer Fehler

Blend Modes ohne Verständnis durchprobieren bis „es gut aussieht“. Besser: Verstehen, was jeder Modus mathematisch macht = gezielter Einsatz.

10. Textebenen & Typografie: Mehr als nur Buchstaben

Was es ist

Photoshops Text-Engine ermöglicht professionelle Typografie direkt im Bildbearbeitungsprogramm – ideal für Poster, Social Media, Thumbnails und Grafik-Design. Für umfangreiche Editorial-Layouts ist Adobe InDesign meist die bessere Wahl, aber für viele kreative Projekte bietet Photoshop ausreichende typografische Funktionalität.

Basis-Text-Funktionen

Text Tool (Horizontal/Vertikal)

- Shortcut: T

- Klick = Punkt-Text (unbegrenzt)

- Ziehen = Absatz-Text (Bounding Box)

Character Panel (Zeichen)

Window > Character- Font-Familie, Stil, Größe

- Kerning (Buchstabenabstand zwischen zwei Zeichen)

- Tracking (Abstand über alle Zeichen)

- Leading (Zeilenabstand)

- Baseline Shift (vertikale Position einzelner Zeichen)

Paragraph Panel (Absatz)

Window > Paragraph- Ausrichtung (linksbündig, zentriert, etc.)

- Einzüge

- Abstand vor/nach Absatz

- Silbentrennung

Professionelle Typografie-Features

1. OpenType-Features

Moderne Fonts haben erweiterte Features:

- Ligaturen (automatische Buchstaben-Kombinationen wie „fi“)

- Alternative Zeichen (Swashes, Stylistic Sets)

- Kapitälchen

Zugriff: Character Panel > Dropdown-Menü oben rechts > OpenType

2. Variable Fonts

Seit CC 2018:

- Fonts mit einstellbaren Achsen (Weight, Width, etc.)

- Stufenlose Anpassung statt fixer Schnitte

- Zugriff: Properties Panel bei aktivem Text-Tool

3. Text auf Pfad

Text folgt Pfad/Form:

- Erstelle Pfad mit Pen Tool oder Form

- Text Tool anwählen

- Klicke auf Pfad

- Tippe Text

Anpassung: Direct Selection Tool (A) + Ziehen an Text-Position auf Pfad

Text-Effekte

Layer Styles für Text:

Rechtsklick auf Textebene > Blending Options

Wichtigste Text-Effekte:

- Drop Shadow: Schlagschatten (Distance, Spread, Size)

- Stroke: Outline um Buchstaben

- Gradient Overlay: Farbverläufe in Text

- Bevel & Emboss: 3D-Effekt

⚠️ Warnung: Leicht zu übertreiben. Subtilität ist Professionalität.

Text rasterisieren vs. Smart Object

Text bleibt editierbar bis:

- Rasterisiert (

Layer > Rasterize > Type) - In Smart Object konvertiert (bleibt vektorbasiert, aber Text nicht mehr editierbar ohne Doppelklick)

Best Practice:

- Entwicklung: Text-Ebene

- Vor Effekten/Transformationen: Smart Object

- Nur wenn nötig: Rasterisieren

Praxistipp: Text-Hierarchie

Professionelle Text-Komposition:

Größe-Kontrast:

- Headline: 100%

- Subheadline: 50-70%

- Body: 30-40%

Font-Paarung:

- Maximal 2-3 Schriftarten

- Kontrast: Serif + Sans-Serif

- Oder: Same Family, Different Weights

Spacing:

- Überschriften: Engeres Tracking (-20 bis 0)

- Body: Standard (0)

- All-Caps: Weiteres Tracking (+50 bis +100)

Fortgeschritten: Text-Masken

1. Text als Maske:

- Halte Ctrl/Cmd beim Klick auf Text-Thumbnail = lädt Text als Auswahl

- Nutze Auswahl für Masken, Cuts, etc.

2. Clipping Mask für Texture-in-Text:

- Bild-Ebene ÜBER Text

- Alt + Klick zwischen Ebenen (oder Ctrl/Cmd + Alt + G)

- Bild erscheint nur in Textform

Beispiel: Fotografie im Text, Grunge-Textures, Glitzer-Effekte

Zusammenfassung: Das Fundament beherrschen

Diese 10 Funktionen sind nicht die einzigen in Photoshop – aber sie sind das Fundament, auf dem alles andere aufbaut.

Die Wahrheit über Photoshop-Expertise:

Es geht nicht darum, jedes Feature zu kennen. Es geht darum:

- Die Kernfunktionen tief zu verstehen – nicht nur WAS sie tun, sondern WARUM und WANN

- Non-destruktive Workflows zu internalisieren – Ebenen, Masken, Smart Objects, Anpassungsebenen

- Kombinationen zu erkennen – Die Macht liegt im Zusammenspiel der Tools

Ein Profi, der diese 10 Bereiche fundiert beherrscht, arbeitet effizienter und zielgerichteter als jemand, der Hunderte Features nur oberflächlich kennt.

Der empfohlene Lernpfad

Woche 1-2: Ebenen & Masken

- Jeden Tag ein Projekt nur mit Ebenen-Organisation und Masken

- Ziel: Keine destruktiven Änderungen mehr

Woche 3-4: Auswahl & Anpassungen

- Freisteller-Übungen

- Farbkorrekturen nur mit Anpassungsebenen

Woche 5-6: Transformationen & Smart Objects

- Kompositionen mit perspektivischen Anpassungen

- Alles als Smart Objects

Woche 7-8: Retusche & Filter

- Portrait-Retusche-Workflow entwickeln

- Smart Filters integrieren

Woche 9-10: Blend Modes & Typografie

- Kreative Effekte mit Mischmodi

- Typografie-Kompositionen

Nach 10 Wochen: Die Grundlagen sitzen. Jetzt kommt Spezialisierung und Geschwindigkeit durch Wiederholung.

Abschließender Gedanke

Photoshop ist wie ein Musikinstrument. Man kann in einer Stunde die Grundtöne lernen. Aber Meisterschaft? Das entsteht durch fokussiertes, wiederholtes Üben der Fundamentals.

Diese 10 Funktionen sind Ihre Grundtöne. Beherrschen Sie sie, und Sie können nahezu jede kreative Vision in Photoshop realisieren.

Alles andere ist Verfeinerung und persönlicher Stil.

Wie dieser Text entstanden ist: Meine Blogartikel entstehen als Sprachmemos. Die werden transkribiert und mit KI-Unterstützung in Form gebracht. Die Erfahrung und die Empfehlungen sind komplett meine. Die Struktur und der Feinschliff entstehen mit KI. Sag ich offen, weil ich’s so halte.