Die Photoshop-Killer – KI-Werkzeuge, die Adobe das Fürchten lehren

Von BROWNZ, dem pixelverdichteten Paranoiker mit Stil

Photoshop war lange der King im digitalen Kolosseum der Bildbearbeitung – ein goldverzierter Despot, der uns alle an seinen Creative-Cloud-Tribut erinnert hat. Doch während Adobe sich monatlich mit Geldsäcken zudeckt, hat im Schatten längst eine neue Generation an Werkzeugen das Licht der Welt erblickt. Schnell, günstig, KI-gestützt – und oft frech genug, die Krone zu fordern.

Hier kommt mein ungeschönter, faktenverliebter Blick auf die härtesten Photoshop-Killer – Programme, die nicht nur mithalten, sondern in manchen Disziplinen sogar überholen. Plus: praktische Tipps für den Einsatz. Kein Hype, kein Hokus-Pokus. Nur echte Werkzeuge für echte Synthografen.

1. Photopea – der kostenlose Klon, der ernst macht

- Was es ist: Ein browserbasiertes Photoshop-Double, das PSDs, Ebenen, Smart Objects und Masken versteht.

- Warum es killt: Läuft in jedem Browser, kostenlos, keine Installation. Öffnet PSDs nativ – perfekt für alle, die keine Abo-Fesseln wollen.

- Pro-Tipp von mir: Nutze Photopea zum schnellen Layer-Editing unterwegs – es funktioniert sogar auf Tablets stabil.

2. Krita – Malen, Retuschieren, Revolution

- Was es ist: Open-Source-Software mit Fokus auf digitale Kunst, aber mit ernstzunehmenden Bildbearbeitungsfeatures.

- Warum es killt: Kein Abo, kein Bullshit. Fantastische Brushes, CMYK-Support, Multilayer-Unterstützung.

- Pro-Tipp von mir: Nutze Krita für künstlerische Composings, bei denen du dynamisch mit Pinseln und Texturen arbeitest. Läuft stabil unter Windows, Mac & Linux.

3. Affinity Photo 2 – der Preis-Leistungs-Killer

- Was es ist: Die ernstzunehmendste kommerzielle Photoshop-Alternative mit Einmalpreis.

- Warum es killt: Raw-Entwicklung, Frequenztrennung, Live-Filter, HDR, Batch-Bearbeitung – alles an Bord. Kein Abo.

- Pro-Tipp von mir: Ideal für professionelle Workflows mit hohem Anspruch – die neue Version unterstützt sogar KI-gestützte Maskierung.

4. Runway ML – die Video-KI, die auch Bilder frisst

- Was es ist: Ein browserbasiertes Powerhouse für Video-Editing, KI-Removal, Inpainting und mehr.

- Warum es killt: Objektentfernung, Stiltransfer, Green-Screen-Ersatz – auf Klick. Selbst Masken ziehen sich die Algorithmen von allein.

- Pro-Tipp von mir: Verwende es für schnelle Removals (z. B. störende Personen), Inpainting mit Style oder auch Videostilkonvertierung.

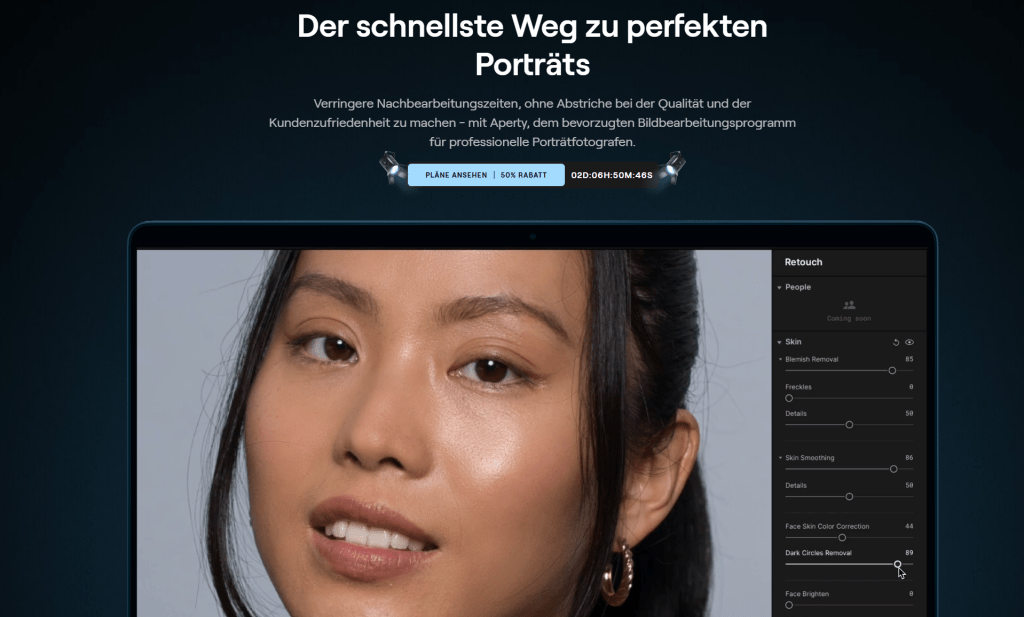

5. Luminar Neo – der Foto-Kosmetiker mit KI im Rücken

- Was es ist: Eine KI-gestützte Bildbearbeitungssoftware für Fotograf:innen.

- Warum es killt: Sky Replacement, Hautretusche, Relighting, AI Composition Tools.

- Pro-Tipp von mir: Super für Porträt-Serien, wenn du schnell perfekte Looks brauchst. Es hat sogar KI-gesteuerte Bokeh-Optimierung.

6. Pixlr E/X – der schnelle Alltagseditor im Browser

- Was es ist: Zwei Varianten – Pixlr X für Einsteiger, Pixlr E für Fortgeschrittene.

- Warum es killt: Drag & Drop, viele Filter, automatische Hintergrundentfernung, alle Grundfunktionen sind da.

- Pro-Tipp von mir: Pixlr ist perfekt für Social-Media-Assets, die du in Minuten mit Layern, Text und Effekten bauen willst – auch mobil.

7. Remove.bg + ClipDrop + Cleanup.pictures – die Killer-Kombo für alle Fälle

- Was sie sind: Drei spezialisierte Webtools für Hintergrundentfernung, Inpainting und Objekt-Cleanup.

- Warum sie killen: Instant Ergebnisse ohne komplizierte Masken. Ideal für E-Commerce, Thumbnails, Composings.

- Pro-Tipp von mir:

- Remove.bg: Für präzise Freisteller.

- Cleanup.pictures: Für Objektentfernung mit Pinselschlag.

- ClipDrop: Für Light & Shadow Control, Text to Image, Relight und mehr.

👉 https://remove.bg

👉 https://cleanup.pictures

👉 https://clipdrop.co

Fazit vom BROWNZ:

Adobe wird nicht morgen sterben. Aber es bekommt verdammt starke Konkurrenz von kleinen, schnellen, bezahlbaren – oder gar kostenlosen – Werkzeugen, die oft sogar effizienter arbeiten. Vor allem in Kombination ergeben diese Tools ein explosives Arsenal für Content-Creator, Synthografen und visuelle Hacker wie mich.

💡 Mein Tipp: Denk nicht in Entweder-Oder. Denk in Werkzeugkasten. Photoshop bleibt der Oldschool-Kampfjet. Aber wer flexibel sein will, fliegt längst mit Drohnen – leise, zielgenau, KI-gesteuert.

#BROWNZout