Ein Plädoyer für eine neue visuelle Kompetenz im Zeitalter synthetischer Medien

Einleitung: Das Ende der fotografischen Unschuld

Es gibt einen Satz, der die westliche Medienkultur über mehr als anderthalb Jahrhunderte geprägt hat wie kaum ein anderer: „Ein Bild sagt mehr als tausend Worte.“ Dieser Satz war nie ganz richtig – aber er war lange Zeit wirksam. Die Fotografie, später das Bewegtbild, galten als Dokumente der Wirklichkeit. Was die Kamera einfing, das war geschehen. Das Bild war Beweis. Es war Zeugnis. Es war Wahrheit.

Diese Ära ist vorbei.

Wir leben heute in einer Welt, in der fotorealistische Bilder in Sekunden generiert werden können – ohne dass je ein Fotograf eine Kamera in der Hand gehalten hätte. In der Videos von Politikern kursieren, die Dinge sagen, die sie nie gesagt haben. In der ein einzelnes, geschickt manipuliertes Bild politische Spannungen schüren kann – man denke etwa an dekontextualisierte Kriegsbilder aus Syrien, der Ukraine oder dem Gaza-Konflikt, die immer wieder in falschen Zusammenhängen durch soziale Medien wandern und dabei Empörung, Hass und Gewaltbereitschaft befeuern. Die technologischen Möglichkeiten der Bildgenerierung und -manipulation haben ein Niveau erreicht, das unsere kulturell tief verankerte Bereitschaft, Bildern zu vertrauen, zu einem ernsthaften gesellschaftlichen Risiko macht.

Dieser Beitrag ist kein Aufruf zur Paranoia. Er ist ein Plädoyer für das, was ich als kompetentes Misstrauen bezeichne: die Fähigkeit, Bilder kritisch zu betrachten, ohne in einen lähmenden Generalverdacht zu verfallen. Es geht um eine neue Kulturtechnik, die so grundlegend werden muss wie das Lesen und Schreiben – eine visuelle Literalität, die der Komplexität unserer medialen Gegenwart gerecht wird.

1. Warum wir Bildern glauben: Die Psychologie des visuellen Vertrauens

Um zu verstehen, warum die Herausforderung so groß ist, müssen wir zunächst verstehen, warum wir Bildern überhaupt so bereitwillig Glauben schenken. Die Antwort liegt tief in unserer Kognition.

Der Primat des Sehens

Der Mensch ist ein visuelles Wesen. Ein erheblicher Teil unserer Großhirnrinde – je nach Studie und Definition zwischen 20 und 35 Prozent – ist an der Verarbeitung visueller Informationen beteiligt. Damit nimmt das Sehen mehr kortikale Ressourcen in Anspruch als jede andere Sinnesmodalität. Evolutionär war das Sehen unser zuverlässigster Sinn: Was wir mit eigenen Augen sahen, war real. Diese biologische Grunddisposition hat sich über Jahrmillionen herausgebildet und lässt sich nicht einfach durch rationale Einsicht überschreiben.

Die Evidenzillusion der Fotografie

Mit der Erfindung der Fotografie im 19. Jahrhundert wurde diese natürliche Vertrauensneigung technisch verstärkt. Die Fotografie schien ein mechanisches Abbild der Realität zu liefern – scheinbar objektiv, scheinbar unbestechlich. Der französische Semiotiker Roland Barthes sprach vom „ça a été“ – dem „Es-ist-so-gewesen“ – als dem Wesenskern der Fotografie. Das Foto bezeugt, dass etwas vor der Linse existiert hat.

Diese Evidenzillusion war von Anfang an problematisch. Schon die frühesten Fotografen wussten um die Macht der Bildauswahl, der Perspektive, des Ausschnitts. Die berühmten Kriegsfotografien des Krimkrieges von Roger Fenton wurden inszeniert. Die ikonischen Bilder des 20. Jahrhunderts – vom Flaggenhissen auf Iwo Jima bis zum Napalm-Mädchen in Vietnam – entfalteten ihre Wirkung nicht allein durch ihren dokumentarischen Gehalt, sondern durch Komposition, Timing und die redaktionellen Entscheidungen, die ihrer Veröffentlichung vorausgingen.

Doch trotz dieser frühen Erkenntnisse hielt sich der kulturelle Glaube an die fotografische Wahrheit hartnäckig. Und genau dieses Erbe macht uns heute verwundbar.

Der Mere-Exposure-Effekt und die Verarbeitungsflüssigkeit

Die kognitionspsychologische Forschung kennt zwei weitere Mechanismen, die unser Bildvertrauen stützen. Der Mere-Exposure-Effekt besagt, dass wir Dinge, die uns vertraut erscheinen, für glaubwürdiger halten. In einer von Bildern gesättigten Medienumgebung erscheint uns das fotografische Bild als das natürlichste Medium der Welt – und damit als das glaubwürdigste.

Hinzu kommt die sogenannte Verarbeitungsflüssigkeit (processing fluency): Informationen, die unser Gehirn schnell und mühelos verarbeiten kann, werden als wahrer empfunden. Bilder werden schneller verarbeitet als Texte. Ein Foto „verstehen“ wir in Millisekunden. Diese kognitive Leichtigkeit macht uns anfällig dafür, die Glaubwürdigkeit des Bildes nicht zu hinterfragen.

2. Von Photoshop zu Midjourney: Die technologische Revolution der Bildmanipulation

Die Manipulation von Bildern ist so alt wie die Fotografie selbst. Doch die technologischen Mittel haben sich in den letzten Jahren qualitativ verändert – und diese qualitative Veränderung erfordert eine qualitativ neue Antwort.

Die erste Welle: Digitale Retusche

Mit dem Aufkommen digitaler Bildbearbeitung in den 1990er Jahren – Photoshop wurde 1990 veröffentlicht – wurde die Bildmanipulation demokratisiert. Plötzlich konnte jeder mit einem Computer Bilder verändern: Personen entfernen, Hintergründe austauschen, Proportionen verzerren. Die Modeindustrie machte davon exzessiven Gebrauch; die Nachrichtenbranche sah sich mit ersten Fälschungsskandalen konfrontiert.

Dennoch blieb die Manipulation in dieser Phase erkennbar – zumindest für geschulte Augen. Forensische Bildanalyse konnte Inkonsistenzen in Beleuchtung, Perspektive oder Pixelstrukturen aufdecken. Die Fälschung war möglich, aber aufwändig. Und sie setzte ein bestehendes Bild voraus, das verändert wurde.

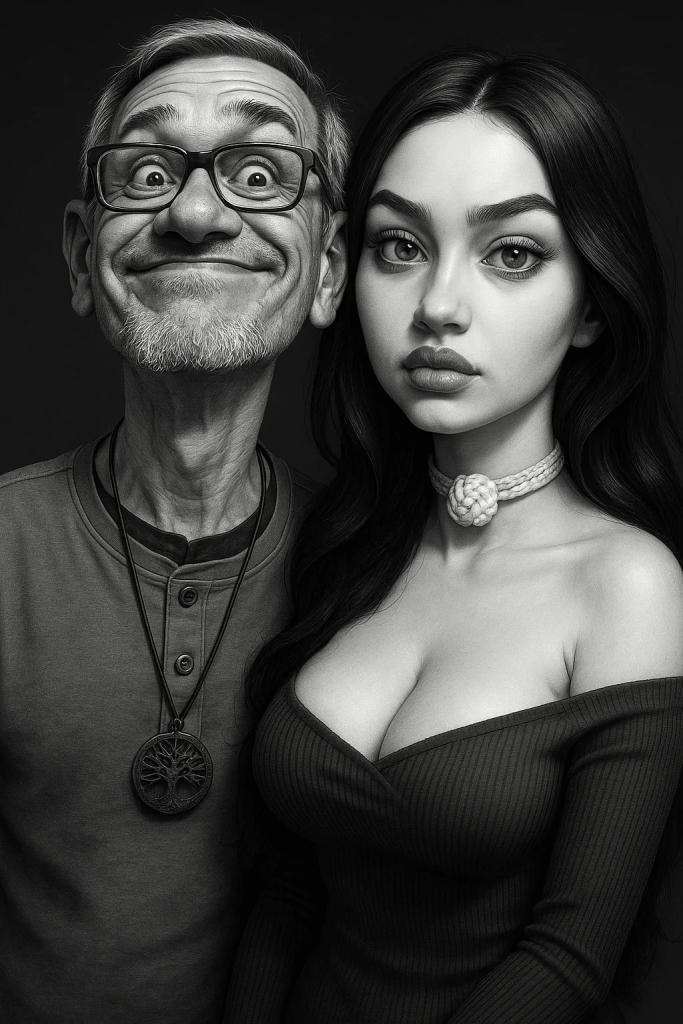

Die zweite Welle: Generative KI

Was wir seit etwa 2022 erleben, ist fundamental anders. Generative KI-Systeme wie DALL-E, Midjourney, Stable Diffusion oder Firefly erzeugen Bilder nicht durch Manipulation bestehender Fotografien, sondern aus dem Nichts. Ein Textprompt genügt, und das System generiert ein fotorealistisches Bild, das kein Referenzbild in der realen Welt hat. Es gibt kein Original, das verfälscht wurde. Es gibt nur ein synthetisches Artefakt, das aussieht wie ein Foto.

Das hat weitreichende Konsequenzen:

- Forensische Analyse wird schwieriger. Traditionelle Methoden der Bildforensik – Analyse von Metadaten, Beleuchtungskonsistenz, Error-Level-Analysis – stoßen bei vollständig generierten Bildern an ihre Grenzen.

- Die technische Einstiegshürde sinkt drastisch. Man braucht kein tiefes technisches Wissen mehr, keine Photoshop-Kenntnisse, keine gestalterische Erfahrung. Ein Satz reicht, um ein fotorealistisches Bild zu erzeugen. Für wirksame Desinformation braucht es zwar weiterhin narrative Kompetenz, Plattformwissen und Reichweite – doch die rein technische Hürde der Bildproduktion ist nahezu verschwunden.

- Die Geschwindigkeit explodiert. Was früher Stunden oder Tage dauerte, geschieht nun in Sekunden. Die Produktion von Desinformation wird skalierbar.

Deepfakes: Wenn das Bewegtbild lügt

Parallel dazu haben sich Deepfake-Technologien entwickelt, die es ermöglichen, Gesichter in Videos auszutauschen, Stimmen zu klonen und ganze Auftritte zu simulieren. Im März 2022 kursierte ein Deepfake-Video des ukrainischen Präsidenten Selenskyj, in dem er angeblich zur Kapitulation aufrief. Die Qualität war damals noch erkennbar mangelhaft – doch die Technologie verbessert sich rasant.

Die Frage ist nicht mehr, ob täuschend echte synthetische Medien möglich sind. Die Frage ist, wie wir als Gesellschaft damit umgehen.

3. Die gesellschaftlichen Folgen: Desinformation, Vertrauenserosion und die „Liar’s Dividend“

Die Verfügbarkeit hochqualitativer synthetischer Bilder und Videos hat bereits heute spürbare gesellschaftliche Auswirkungen.

Desinformation und Manipulation

Der offensichtlichste Effekt ist die Verwendung gefälschter oder generierter Bilder zur gezielten Desinformation. Ob in politischen Kampagnen, in Kriegspropaganda oder in verschwörungstheoretischen Netzwerken – das synthetische Bild ist zur Waffe geworden. Die Geschwindigkeit sozialer Medien tut ihr Übriges: Ein falsches Bild kann sich viral verbreiten, bevor irgendein Faktencheck greifen kann. Die emotionale Wirkung des Bildes ist längst entfaltet, wenn die Korrektur kommt – und die Korrektur erreicht ohnehin nur einen Bruchteil der ursprünglichen Reichweite.

Besonders perfide ist dabei die Tatsache, dass KI-generierte Bilder oft gezielt auf emotionale Trigger setzen: leidende Kinder, brennende Gebäude, empörende Szenen. Sie nutzen unsere empathischen Reflexe gegen uns. Wer ein Bild eines weinenden Kindes sieht, prüft nicht als Erstes die Metadaten. Er fühlt – und handelt.

Die Erosion des Grundvertrauens

Doch die Desinformation ist nur die eine Seite des Problems. Die andere – und möglicherweise gravierendere – ist die Erosion des Grundvertrauens in visuelle Medien insgesamt. Wenn jedes Bild gefälscht sein könnte, warum sollte man irgendeinem Bild noch glauben?

Diese Dynamik ist toxisch, denn sie untergräbt auch die Glaubwürdigkeit authentischer Bilder. Seriöser Fotojournalismus, dokumentarische Aufnahmen von Menschenrechtsverletzungen, Beweisfotos – sie alle geraten unter Generalverdacht. Die Wahrheit wird nicht nur durch Fälschungen beschädigt, sondern auch dadurch, dass die bloße Möglichkeit der Fälschung ausreicht, um Zweifel zu säen.

Die „Liar’s Dividend“

Die Rechtswissenschaftler Robert Chesney und Danielle Citron haben dieses Phänomen als „Liar’s Dividend“ bezeichnet: den Vorteil, den Lügner daraus ziehen, dass Deepfakes und synthetische Medien existieren. Jeder, der mit einem kompromittierenden Bild oder Video konfrontiert wird, kann nun behaupten: „Das ist ein Deepfake.“ Und diese Behauptung ist schwer zu widerlegen – denn tatsächlich könnte es ein Deepfake sein.

Politiker nutzen dieses Narrativ bereits. Autokratische Regime nutzen es, um Beweise für Menschenrechtsverletzungen zu diskreditieren. Die „Liar’s Dividend“ schafft eine Welt, in der nicht nur Lügen als Wahrheit, sondern auch Wahrheiten als Lügen verkauft werden können. Das ist die eigentliche epistemische Krise unserer Zeit.

4. Kompetentes Misstrauen: Was wir brauchen – und was nicht

Angesichts dieser Lage wäre die naheliegende Reaktion, allem zu misstrauen. Doch genau das wäre falsch. Ein generalisiertes Misstrauen gegenüber allen Bildern führt in denselben epistemischen Nihilismus, den die Produzenten von Desinformation anstreben. Wenn nichts mehr wahr sein kann, ist alles gleich gültig – und damit gleichgültig.

Was wir stattdessen brauchen, ist das, was ich als kompetentes Misstrauen bezeichne: eine differenzierte, informierte und kontextbezogene Haltung gegenüber visuellen Medien. Aktuelle Forschung stützt diesen Ansatz: Studien zeigen, dass gezielte Literacy-Interventionen Menschen tatsächlich besser darin machen, Deepfakes zu erkennen – ohne das Vertrauen in authentische Bilder komplett zu zerstören. Kompetentes Misstrauen ist also kein theoretisches Ideal, sondern eine erlernbare Fähigkeit mit nachgewiesener Wirksamkeit.

Die Grundprinzipien kompetenten Misstrauens

1. Quelle vor Inhalt. Die erste Frage bei jedem Bild sollte nicht sein: „Was zeigt es?“, sondern: „Woher kommt es?“ Ein Bild, das von einer etablierten Nachrichtenagentur mit klarer Quellenangabe veröffentlicht wird, verdient ein anderes Maß an Vertrauen als ein Bild, das anonym in einem Telegram-Kanal auftaucht. Das klingt banal – aber in der Praxis wird diese einfache Prüfung erstaunlich selten durchgeführt.

2. Kontext prüfen. Bilder werden häufig nicht gefälscht, sondern dekontextualisiert. Ein echtes Foto wird mit einer falschen Bildunterschrift versehen, einem anderen Zeitpunkt zugeordnet oder in einen irreführenden narrativen Rahmen gestellt. Die Rückwärts-Bildersuche (etwa über Google Images oder TinEye) ist ein einfaches, aber erstaunlich wirksames Werkzeug, um solche Dekontextualisierungen aufzudecken.

3. Emotionale Distanz wahren. Bilder, die starke Emotionen auslösen – Empörung, Mitleid, Wut, Begeisterung – verdienen besondere Vorsicht. Nicht weil Emotionen illegitim wären, sondern weil sie unsere kritische Urteilsfähigkeit herabsetzen. Die bewusste Entscheidung, vor dem Teilen innezuhalten und zu prüfen, ist ein Akt intellektueller Selbstdisziplin.

4. Technische Hinweise kennen. Auch wenn die Qualität synthetischer Bilder rasant steigt, gibt es nach wie vor typische Artefakte: unnatürliche Hände, inkonsistente Textdarstellungen, merkwürdige Hintergründe, zu perfekte Haut, fehlende oder verdoppelte Accessoires. Diese Hinweise zu kennen ersetzt keine technische Analyse – aber es schärft den Blick.

5. Unsicherheit aushalten. Kompetentes Misstrauen bedeutet auch, zu akzeptieren, dass man manchmal nicht wissen kann, ob ein Bild authentisch ist. Diese Unsicherheit auszuhalten, ohne vorschnell zu urteilen, ist eine Kompetenz, die in einer von Gewissheitsansprüchen dominierten Medienkultur besonders schwer fällt – aber umso wichtiger ist.

5. Bildung, Institutionen, Technologie: Ein Drei-Säulen-Modell

Kompetentes Misstrauen kann nicht allein eine individuelle Leistung sein. Es braucht strukturelle Unterstützung auf drei Ebenen.

Säule 1: Bildung

Visuelle Medienkompetenz muss zu einem festen Bestandteil schulischer und außerschulischer Bildung werden. Nicht als Wahlfach, nicht als Projektwoche, sondern als Querschnittskompetenz, die in verschiedenen Fächern verankert wird: in der Politischen Bildung, im Kunstunterricht, in der Informatik, im Deutschunterricht.

Kinder und Jugendliche müssen lernen:

- wie Bilder produziert und verbreitet werden,

- welche Absichten hinter Bildkommunikation stehen können,

- wie generative KI funktioniert (auf konzeptioneller Ebene),

- welche Werkzeuge zur Verifizierung zur Verfügung stehen,

- und wie man mit Unsicherheit umgeht.

Dabei geht es nicht darum, eine Generation von Zynikern heranzuziehen, die keinem Medium mehr traut. Es geht darum, mündige Mediennutzerinnen und Mediennutzer zu bilden, die in der Lage sind, informierte Urteile zu fällen. Die Analogie zum Lesenlernen ist hier keine Übertreibung: So wie die Alphabetisierung die Voraussetzung für die Teilhabe an der Schriftkultur war, ist visuelle Literalität die Voraussetzung für die Teilhabe an der digitalen Medienkultur.

Säule 2: Institutionelle Verantwortung

Medienorganisationen, Plattformen und staatliche Institutionen tragen eine besondere Verantwortung.

Medienorganisationen müssen ihre Verifizierungsprozesse stärken und transparent machen. Nachrichtenagenturen wie AP, Reuters oder die dpa investieren bereits erheblich in Faktenchecking und Bildverifizierung. Diese Arbeit muss sichtbarer werden – nicht nur als nachträgliche Korrektur, sondern als integraler Bestandteil der Berichterstattung.

Plattformen – von Meta über X bis TikTok – müssen technische und regulatorische Maßnahmen ergreifen, um die Verbreitung synthetischer Medien ohne Kennzeichnung einzudämmen. Content-Authentifizierungsinitiativen wie die Content Authenticity Initiative (CAI) oder der C2PA-Standard (Coalition for Content Provenance and Authenticity) arbeiten an digitalen Herkunftsnachweisen für Medieninhalte: einer Art „Lieferkette“ für Bilder, die dokumentiert, wann, wo und wie ein Bild erstellt und bearbeitet wurde. Wichtig ist dabei: Solche Standards belegen Provenienz, nicht Wahrheit. Sie können nachweisen, woher ein Bild stammt und welche Bearbeitungsschritte es durchlaufen hat – aber sie können nicht garantieren, dass das Abgebildete die Realität korrekt wiedergibt. Trotzdem sind sie ein entscheidender Baustein, weil sie Transparenz schaffen, wo bisher Intransparenz herrschte.

Staatliche Akteure müssen regulatorische Rahmenbedingungen schaffen. Die EU hat mit dem AI Act einen ersten Schritt getan, indem sie Kennzeichnungspflichten für KI-generierte Inhalte vorsieht. Doch Regulierung allein löst das Problem nicht – sie muss von Bildung und technischen Lösungen flankiert werden.

Säule 3: Technologische Werkzeuge

Die Technologie, die das Problem verursacht, muss auch Teil der Lösung sein. Dazu gehören:

- KI-basierte Detektionstools, die synthetische Bilder erkennen können (auch wenn dies ein Katz-und-Maus-Spiel bleibt),

- Digitale Wasserzeichen und Metadaten-Standards, die die Herkunft von Bildern nachvollziehbar machen,

- Browser-Plugins und Apps, die Nutzerinnen und Nutzern einfache Verifizierungswerkzeuge an die Hand geben,

- und offene Datenbanken, die bekannte manipulierte oder generierte Bilder katalogisieren.

Entscheidend ist, dass diese Werkzeuge niedrigschwellig zugänglich sind. Die beste Verifizierungstechnologie nützt nichts, wenn sie nur Expertinnen und Experten zur Verfügung steht. Sie muss in die alltägliche Mediennutzung integriert werden – so selbstverständlich wie der Spamfilter im E-Mail-Postfach.

6. Die ethische Dimension: Misstrauen als Verantwortung

Kompetentes Misstrauen ist nicht nur eine kognitive Fähigkeit – es ist eine ethische Haltung. Wer ein ungeprüftes Bild teilt, das sich als Fälschung herausstellt, trägt Mitverantwortung für die Desinformation, die daraus entsteht. Wer ein authentisches Bild vorschnell als Fälschung abtut, trägt Mitverantwortung für die Erosion der Wahrheit.

Diese doppelte Verantwortung – weder leichtgläubig noch zynisch zu sein – ist anspruchsvoll. Sie verlangt kognitive Anstrengung in einem medialen Umfeld, das auf Schnelligkeit, Emotionalität und Vereinfachung optimiert ist. Aber genau darin liegt die ethische Herausforderung unserer Zeit: die Bereitschaft, langsamer zu denken als die Algorithmen es von uns verlangen.

Die Philosophin Onora O’Neill hat in ihren Arbeiten zum Vertrauen darauf hingewiesen, dass informiertes Vertrauen – im Gegensatz zu blindem Vertrauen – immer auch die Bereitschaft zum Misstrauen einschließt. Vertrauen ohne die Möglichkeit des Misstrauens ist Naivität. Misstrauen ohne die Möglichkeit des Vertrauens ist Paranoia. Was wir brauchen, ist die Fähigkeit, uns bewusst und begründet zwischen beiden Polen zu bewegen.

7. Ein Blick nach vorn: Leben in der postfotografischen Welt

Manche Theoretiker sprechen bereits von einer postfotografischen Ära – einer Zeit, in der das Bild seinen Status als Beweismittel endgültig verloren hat. Ich halte diese Diagnose für verfrüht, aber nicht für unbegründet. Was sich zweifellos verändert hat, ist die Beweislast: Während früher die Fälschung nachgewiesen werden musste, muss zunehmend die Authentizität belegt werden.

Diese Verschiebung hat tiefgreifende Auswirkungen auf den Journalismus, die Rechtsprechung, die Wissenschaft und den gesellschaftlichen Diskurs insgesamt. Sie verlangt neue Standards, neue Werkzeuge und – vor allem – neue Kompetenzen.

Doch ich bin nicht pessimistisch. Jede medientechnologische Revolution – der Buchdruck, der Rundfunk, das Internet – hat zunächst Phasen der Verunsicherung und des Missbrauchs durchlaufen, bevor sich gesellschaftliche Normen, Institutionen und Kompetenzen herausbildeten, die einen konstruktiven Umgang ermöglichten. Wir stehen am Anfang eines solchen Prozesses.

Die entscheidende Frage ist, ob wir diesen Prozess aktiv gestalten oder ob wir ihn geschehen lassen. Ob wir in Bildung investieren oder auf technologische Selbstregulation hoffen. Ob wir den Diskurs über visuelle Wahrheit führen oder ihn den Extremen überlassen – den Leichtgläubigen auf der einen und den Nihilisten auf der anderen Seite.

Fazit: Sehen lernen – neu

Die Fähigkeit zu sehen ist uns angeboren. Die Fähigkeit, dem Gesehenen kompetent zu begegnen, ist es nicht. Sie muss erlernt, geübt und institutionell gestützt werden.

Der Wahrheit ins Auge zu sehen bedeutet heute auch, der Fragilität visueller Wahrheit ins Auge zu sehen. Es bedeutet, die Grenzen unserer Wahrnehmung anzuerkennen, die Leistungsfähigkeit generativer Technologien ernst zu nehmen und die eigene Urteilsfähigkeit bewusst zu schärfen.

Kompetentes Misstrauen ist kein Zeichen von Schwäche oder Zynismus. Es ist ein Ausdruck intellektueller Reife und demokratischer Verantwortung. In einer Welt, in der Bilder mächtiger sind als je zuvor – und zugleich trügerischer als je zuvor – ist die Fähigkeit, klug zu zweifeln, eine der wichtigsten Kompetenzen, die wir entwickeln können.

Lernen wir, Bildern zu misstrauen – nicht um sie zu verwerfen, sondern um ihnen den Respekt entgegenzubringen, den sie verdienen: den Respekt einer kritischen, wachen und informierten Betrachtung.

Über den Autor: Dieser Beitrag wurde aus der Perspektive eines Experten für Medienkompetenz und visuelle Kommunikation verfasst. Er versteht sich als Diskussionsbeitrag an der Schnittstelle von Medientheorie, Kognitionspsychologie und digitaler Ethik.

Änderungsprotokoll gegenüber der Erstfassung

Im Sinne der Transparenz dokumentiere ich hier die vorgenommenen Korrekturen und Präzisierungen:

- „30 Prozent der Großhirnrinde“ → geändert zu „zwischen 20 und 35 Prozent, je nach Studie und Definition“. Die ursprüngliche Angabe war als populärwissenschaftliche Faustformel vertretbar, aber als harte Zahl wissenschaftlich nicht präzise genug.

- „Die Qualität verbessert sich exponentiell“ → geändert zu „rasant“. „Exponentiell“ suggeriert ein streng mathematisches Wachstumsgesetz, das hier nicht belegt ist.

- „Die Einstiegshürde sinkt auf null“ → geändert zu „Die technische Einstiegshürde sinkt drastisch“, ergänzt um den Hinweis, dass wirksame Desinformation weiterhin narrative Kompetenz, Plattformwissen und Reichweite erfordert.

- „Ein einzelnes manipuliertes Bild kann geopolitische Spannungen auslösen“ → ergänzt um konkrete Beispiele (dekontextualisierte Kriegsbilder aus Syrien, der Ukraine und dem Gaza-Konflikt), um die Aussage zu belegen.

- C2PA-Passage → ergänzt um die explizite Klarstellung, dass der Standard Provenienz, nicht Wahrheit belegt.

- Abschnitt „Kompetentes Misstrauen“ → ergänzt um den Hinweis auf aktuelle Forschung, die zeigt, dass gezielte Literacy-Interventionen Deepfake-Erkennung verbessern, ohne generelles Bildvertrauen zu zerstören.

- „Rechtsprofessoren“ → geändert zu „Rechtswissenschaftler“ (präzisere und im Deutschen üblichere Bezeichnung).

Wie dieser Text entstanden ist: Meine Blogartikel entstehen als Sprachmemos. Die werden transkribiert und mit KI-Unterstützung in Form gebracht. Die Erfahrung und die Empfehlungen sind komplett meine. Die Struktur und der Feinschliff entstehen mit KI. Sag ich offen, weil ich’s so halte.