KI, Angst und die große Frage: Womit wurde das Ding eigentlich gefüttert?

1. Einführung

Künstliche Intelligenz ist das neue Internet, nur mit mehr Schlagzeilen, mehr Missverständnissen und mehr Grund, sich nachts wach im Bett zu wälzen. Für die einen ist sie der Zauberstab, der Arbeit, Kunst und Alltag revolutioniert. Für die anderen ist sie der große digitale Vampir, der uns aussaugt, unsere Kreativität stiehlt und sie im Hochglanzformat zurückverkauft. Besonders viel Nervosität gibt es bei einer Frage: Mit welchen Daten wurde KI eigentlich trainiert?

Diese Frage trifft ins Mark, weil sie gleich mehrere menschliche Grundängste berührt: Angst vor Kontrollverlust, Angst vor Missbrauch, Angst vor dem eigenen digitalen Spiegelbild. Wenn alles, was wir ins Internet gepostet haben – von der Schulhof-Collage über Flickr bis hin zur Herzschmerz-Lyrik auf MySpace – Teil eines gigantischen Datensees ist, den Maschinen zum Lernen nutzen, dann kratzt das nicht nur am Urheberrecht, sondern auch an unserem Selbstbild.

In diesem Text gehe ich tiefer: Woher kommt die Angst wirklich? Was ist berechtigt, was Hysterie? Wie neutral kann man das betrachten? Und wie lässt sich KI so nutzen, dass sie Werkzeug bleibt – und nicht wie ein außer Kontrolle geratenes Biest wirkt? Ein Blogtext mit 3000+ Wörtern, der neutral, reflektiert und trotzdem im Brownz-Stil bissig, humorvoll und pointiert bleibt.

2. Der Datenhunger der Maschinen – ein Buffet ohne Ende

Um KI-Modelle trainieren zu können, braucht es Daten. Gigantische Mengen an Daten. Daten sind für KI das, was Kaffee für Designer ist: ohne läuft gar nichts. Es geht nicht um Hunderte Bilder, sondern um Milliarden. Texte, Fotos, Songs, Videos, Code-Schnipsel – alles, was Menschen jemals online gelassen haben. Ein gigantisches „All you can eat“-Buffet der digitalen Kultur.

Die Idee dahinter ist simpel: je mehr Beispiele, desto besser kann die KI Muster erkennen. Sie sieht tausende Gemälde und lernt, was impressionistisch ist. Sie liest Millionen Artikel und beginnt, Sprachmuster zu erkennen. Sie schaut sich Millionen Fotos an und lernt, wie Schatten, Hauttöne oder Wolken aussehen. Klingt effizient. Aber es wirft sofort unbequeme Fragen auf: Wer hat diese Daten bereitgestellt? Wurde gefragt, bevor sie ins Training geworfen wurden? Und wie trennt man frei verfügbare Inhalte von geschützten?

Hier beginnt die Angst: Wir alle wissen, dass wir seit Jahren Inhalte ins Internet pumpen, ohne groß darüber nachzudenken. Doch jetzt, da Maschinen sie nutzen, fühlen wir uns plötzlich enteignet. Wie ein Musiker, der merkt, dass seine alten Demo-Tapes plötzlich auf der Party laufen, aber jemand anderes dafür den Applaus kassiert.

3. Die Psychologie der Angst

Warum löst die Frage nach den Trainingsdaten so viel Panik aus? Weil es drei Dinge gleichzeitig berührt:

- Kontrolle: Wir haben das Gefühl, dass unsere Werke aus der Hand genommen und ohne Zustimmung in fremden Kontexten recycelt werden.

- Identität: Wenn eine KI meinen Stil kopiert – bin ich dann noch einzigartig? Oder werde ich zum austauschbaren Pixel im Datensee?

- Transparenz: Niemand weiß so genau, welche Datenbanken, welche Scraper, welche Quellen genutzt wurden. Diese Intransparenz ist der perfekte Nährboden für Misstrauen.

Angst entsteht also nicht primär, weil Maschinen Daten verarbeiten – sondern weil wir nicht wissen, woher die Daten kommen und wohin sie gehen. Menschen hassen Blackboxes. Wir wollen sehen, was im Mixer steckt, bevor wir das Smoothie trinken.

4. Neutral betrachtet: KI ist kein Dieb, sondern ein Spiegel

Objektiv betrachtet muss man nüchtern bleiben: KI ist keine bewusste Entität, die nachts in Galerien schleicht und Bilder klaut. Sie speichert keine Dateien im klassischen Sinn, sie lernt Muster, Wahrscheinlichkeiten, Beziehungen. Sie „weiß“ nicht, dass dieses Gedicht von dir ist oder jenes Foto aus deinem Urlaub stammt. Sie erkennt nur, dass bestimmte Strukturen funktionieren. Sie ist kein Dieb – sie ist ein Spiegel, der unendlich viele Reflexionen aus Milliarden kleiner Fragmente zusammenbaut.

Das moralische Problem entsteht nicht in der Maschine, sondern in den Rahmenbedingungen, die Menschen gesetzt haben. Wer hat erlaubt, dass Daten ohne Zustimmung gescraped werden? Welche Gesetze hinken dem technischen Fortschritt hinterher? Welche Unternehmen haben Transparenz als Luxusartikel behandelt, statt als Grundprinzip?

Die Angst richtet sich also nicht gegen die Technologie selbst, sondern gegen die Kombination aus Macht, Intransparenz und fehlender Regulierung.

5. Zwischen Hype und Horror

Es ist faszinierend, wie stark der Diskurs kippt. An einem Tag heißt es: „KI wird die Kreativbranche retten!“ Am nächsten: „KI zerstört alles, was wir lieben!“ Diese Extreme machen Schlagzeilen, aber sie helfen uns nicht, nüchtern zu bleiben. Die Wahrheit liegt – wie immer – dazwischen.

- Ja, KI kann Jobs verändern. Einige Tätigkeiten werden automatisiert, andere entstehen neu.

- Ja, es gibt Risiken von Missbrauch – Deepfakes, Plagiate, Fehlinformation.

- Aber genauso gibt es Chancen: neue Werkzeuge, Effizienzsteigerung, Demokratisierung von Kreativität.

Der Hype verkauft Träume, die Panik verkauft Klicks. Was fehlt, ist eine Kultur des klaren Hinsehens: Wo genau liegen die Probleme, und wo entstehen echte Chancen?

6. Brownz-Perspektive: Der Mixer der Kulturgeschichte

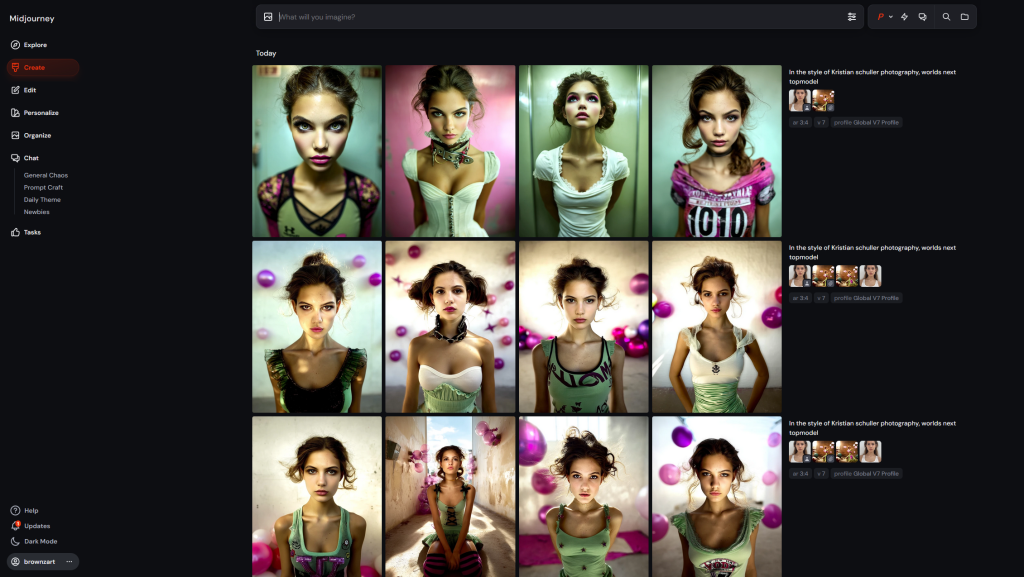

Stell dir KI wie einen Mixer vor. Du kippst alles rein, was die Menschheit jemals gemacht hat: Bücher, Fotos, Lieder, Tweets, Memes. Drückst auf Start. Heraus kommt ein Brei, der mal nach Bach klingt, mal nach TikTok, mal nach beidem gleichzeitig. Niemand weiß genau, welcher Geschmack dominiert. Und plötzlich serviert jemand diesen Brei als Haute Cuisine – mit Michelin-Stern.

Klar, das erzeugt Frust. Wenn mein Rezept plötzlich im Mixer landet, will ich wenigstens erwähnt werden. Wenn mein Meme von 2011 in einer KI-Bildidee wieder auftaucht, will ich nicht das Gefühl haben, dass jemand meine Witze klaut. Der Kern des Problems: fehlende Attribution. Menschen wollen Anerkennung, nicht nur Inspiration.

7. Rechtliche Grauzonen

Das Urheberrecht hinkt gnadenlos hinterher. Ein Bild zu kopieren ist klar verboten. Aber was ist, wenn eine Maschine aus Millionen Bildern ein statistisches Modell baut? Ist das Kopie oder Inspiration? Gerichte weltweit ringen mit dieser Frage, und jede Entscheidung könnte das Spielfeld neu definieren.

Die Angst der Kreativen hat also einen realen Kern: Sie bewegt sich in einem Graubereich, in dem Gesetze aus der Druckerpresse-Ära plötzlich auf neuronale Netze treffen. Ein Clash der Systeme.

8. Chancen sehen

Trotz aller Risiken wäre es naiv, nur auf die Bedrohungen zu schauen. KI kann Kreativität auch entlasten:

- Nervige Routinen automatisieren.

- Vorschläge liefern, die jenseits des eigenen Tunnelblicks liegen.

- Menschen Werkzeuge geben, die sonst nie Zugang zu professionellem Design gehabt hätten.

Die Herausforderung: Chancen nutzen, ohne blind zu werden für die Probleme.

9. Eigene Gedanken: Angst als Kompass

Angst ist nicht nur Lähmung, sondern auch Kompass. Sie zeigt uns, wo Regeln fehlen, wo Transparenz gebraucht wird, wo Macht zu einseitig verteilt ist. Statt KI reflexhaft zu verteufeln oder unkritisch zu feiern, sollten wir die Angst als Einladung verstehen: Fragt nach, hakt nach, fordert Aufklärung.

Wer Angst spürt, ist wach. Und Wachheit ist das Gegenteil von Manipulierbarkeit.

10. Fazit: KI ist weder Teufel noch Messias

KI ist nicht gekommen, um uns zu retten oder zu zerstören. Sie ist gekommen, weil wir die Welt mit Daten gefüttert haben, und jetzt kommt die Quittung. Die Angst ist verständlich, sie ist real, aber sie darf nicht lähmen. Stattdessen brauchen wir Haltung: kritisch, neugierig, wachsam.

KI ist Werkzeug. Ob sie Konkurrent wird oder Partner, entscheidet nicht die Maschine, sondern wir.

10 geheime Tipps, um konstruktiv mit der KI-Angst umzugehen

- Informieren statt spekulieren – Wissen nimmt Panik den Schrecken.

- Eigene Daten reflektieren – Überlege, was du online stellst und warum.

- Transparenz fordern – Je mehr Einblick in Trainingsprozesse, desto fairer.

- Gemeinsam diskutieren – Angst schrumpft, wenn sie geteilt wird.

- Experimentieren – KI ausprobieren, statt nur von außen zu fürchten.

- Rechtliche Entwicklungen verfolgen – Wissen, was Gerichte entscheiden.

- Eigene Handschrift kultivieren – Kein Algorithmus ersetzt menschliche Einzigartigkeit.

- Ethik aktiv einfordern – Unternehmen unter Druck setzen, Verantwortung zu übernehmen.

- Balance finden – Chancen nutzen, ohne Risiken zu verdrängen.

- Humor behalten – Angst verliert Macht, wenn man über sie lachen kann.

Endgedanke

KI ist ein Spiegel. Und Spiegel machen Angst, wenn man genau hinsieht. Aber sie zeigen auch, was möglich ist. Entscheidend ist, ob wir reinschauen, wegschauen – oder den Spiegel zerschlagen und uns dann über die Scherben wundern.