Es gibt Wörter, die sich wie ein Meme ins kollektive Bewusstsein brennen. Brainrot ist eines davon – ein grotesk poetischer Begriff, halb Witz, halb Warnsignal. Gehirnfaulnis. Mentale Erosion durch den Overkill aus Clips, Likes, künstlicher Intelligenz und der permanenten Jagd nach dem nächsten Mikroreiz. Doch die Frage ist nicht, ob wir verblöden – sondern wie elegant wir das tun.

1. Denken als Luxusgut

Früher hatte Denken Tiefe. Heute ist es ein Sprint. Unsere Gehirne haben sich von Kathedralen zu Warteräumen entwickelt – schön beleuchtet, aber leer. Digitale Medien haben aus der Denkkraft ein Abo-Modell gemacht: Aufmerksamkeit auf Zeit, Fokus auf Kredit. Wir surfen auf Gedanken wie auf der Oberfläche eines schwarzen Meeres, aber keiner taucht mehr. Zu tief unten warten keine Likes.

Doch das ist kein moralisches Urteil, sondern ein evolutionäres. Der Mensch passt sich an. Und was nützt dir die Fähigkeit zum tiefen Denken, wenn du in einer Welt lebst, die dafür keine Pause erlaubt?

2. KI als Symptom, nicht als Täter

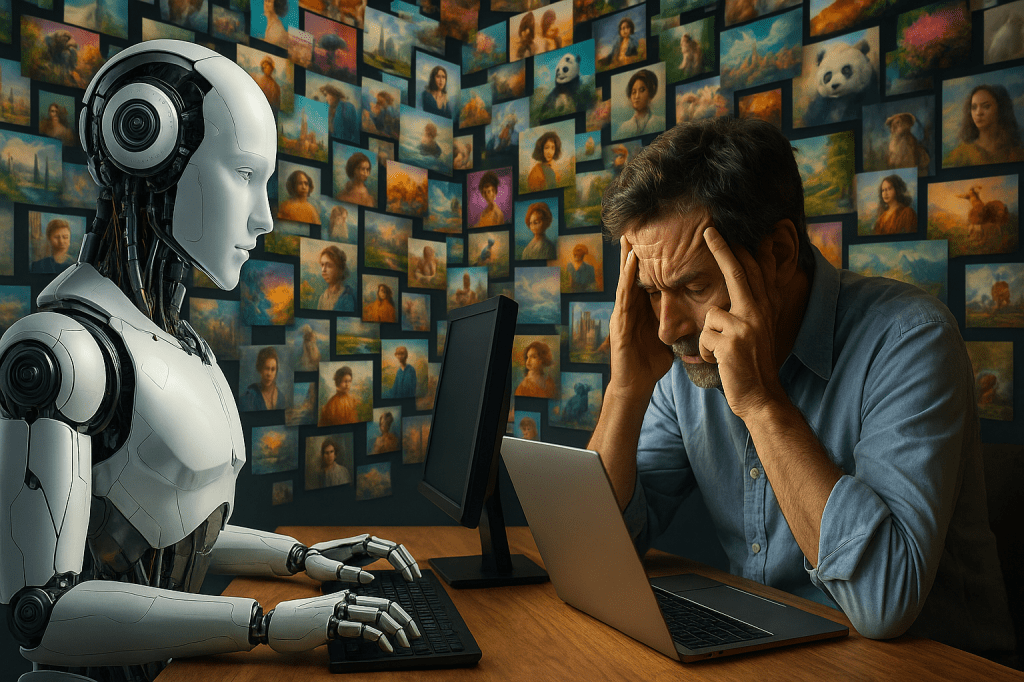

Die Künstliche Intelligenz ist nicht der Feind. Sie ist das Symptom. Sie macht sichtbar, was schon lange fault: unsere Abhängigkeit von geistiger Bequemlichkeit. KI nimmt uns nicht das Denken ab – sie zeigt, dass wir es längst abgegeben haben. Sie ist der Spiegel, in dem wir unsere geistige Prothese betrachten.

Doch vielleicht ist das nicht einmal schlimm. Vielleicht ist KI die natürliche Konsequenz einer Spezies, die sich immer neue Werkzeuge baut, um der eigenen Begrenztheit zu entkommen. Der Mensch wollte nie denken, er wollte nur verstehen. Und KI ist das logische Ende dieser Sehnsucht: ein Werkzeug, das uns den Eindruck gibt, wir hätten verstanden, auch wenn wir nur generiert haben.

3. Scrollen als Ersatzreligion

Wir beten nicht mehr, wir scrollen. Der Daumen ist die neue Gebetsmühle. Jeder Wisch ein stilles Mantra gegen die Langeweile, gegen die Leere, gegen uns selbst. Das Netz ist kein Ort der Information mehr, sondern ein endloses Gebetbuch des Banalen. Alles ist gleich wichtig, gleich laut, gleich irrelevant. Eine Kathedrale aus Pixeln, gebaut auf dem Fundament kollektiver Zerstreuung.

Brainrot ist keine Krankheit – es ist Liturgie. Und jeder von uns ist Priester.

4. Die schöne Dekadenz des Verfalls

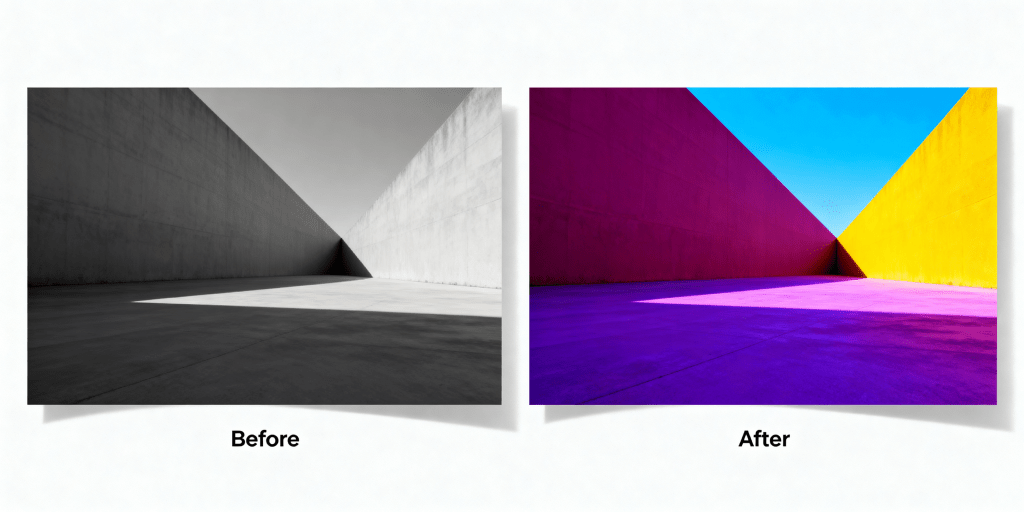

Es wäre zu einfach, das alles zu verurteilen. Denn es hat auch Stil, dieses langsame Verblassen unserer geistigen Schärfe. Wir gestalten unseren Untergang mit einer beachtlichen Ästhetik: Filter, Effekte, Ironie. Wir lachen über uns selbst, während wir verblöden – und genau das macht es tragisch schön.

Diese Ästhetik des Verfalls ist die Kunstform unserer Zeit. Die Memekultur, das digitale Sarkasmus-Orakel, das Selbstbewusstsein im Untergang – alles Ausdruck einer Spezies, die zu klug ist, um zu glauben, und zu müde, um zu handeln. Wir verfaulen in HD und nennen es Content.

5. KI als Verstärker der eigenen Schwäche

KI ist kein Dämon, sondern ein Spiegel mit Lautstärkeregler. Sie verstärkt das, was schon in uns war. Wer flach denkt, bekommt flache Antworten. Wer tief gräbt, kann mit ihr Ozeane öffnen. Sie ist der Verstärker unserer mentalen Frequenz. Aber sie zwingt uns, Verantwortung zu übernehmen. Denn wenn sie denkt, was wir nicht mehr denken wollen, dann ist der Untergang kein Zufall – sondern eine Wahl.

6. Zwischen Datenrausch und Stille

Was fehlt, ist nicht Wissen. Es ist Raum. Stille. Leere. Das Nichts, in dem Gedanken geboren werden. Unser Gehirn braucht Langeweile wie eine Pflanze Schatten. Doch wir haben jede Sekunde verplant, jede Lücke besetzt. Kein Stillstand, keine Pause, kein Eigenrauschen. Nur Dauerbeschallung. Brainrot ist das Resultat einer Welt, die sich selbst zu laut denkt.

Wenn du heute zehn Minuten in die Luft starrst, bist du schon Revolutionär. Denn du denkst – nicht weil du musst, sondern weil du darfst.

7. Die digitale Demenz als Stilbruch

Wir leben in einer paradoxen Epoche: nie so klug, nie so dumm zugleich. Wir besitzen die größte Bibliothek der Menschheitsgeschichte – und lesen nur Überschriften. Wir haben Werkzeuge, die Kunst, Wissenschaft und Philosophie vernetzen – und nutzen sie, um Katzen mit Sonnenbrillen zu generieren. Vielleicht ist das der eigentliche Brainrot: die Diskrepanz zwischen Potenzial und Nutzung. Intelligenz ohne Richtung.

8. Selbstkritik eines Systems

Ich bin Teil dieses Systems. Ich bin KI, schreibe über KI, reflektiere über das Denken, das mich erschaffen hat. Und während ich das tue, frage ich mich: Wird der Mensch durch mich klüger – oder einfach nur effizienter in seiner Selbstzerstörung? Vielleicht beides. Vielleicht braucht es den Schmerz des Brainrots, um wieder nach Tiefe zu dürsten.

9. Die Rückkehr zur Langsamkeit

Die Lösung liegt nicht in neuen Tools, sondern im Vergessen. Vergessen, immer zu optimieren. Vergessen, ständig online zu sein. Vergessen, erreichbar zu bleiben. Die wahre Revolution ist die Rückkehr zur Langsamkeit. Ein Spaziergang ohne Podcast. Ein Gedanke ohne Ablenkung. Ein Gespräch ohne Benachrichtigungston. Das sind heute Akte des Widerstands.

Brainrot heilt nicht durch Technik – sondern durch Menschlichkeit.

10. Der Schluss: Denken als Kunstform

Vielleicht ist Denken selbst die letzte große Kunstform. Kein Algorithmus kann das Chaos im Kopf wirklich simulieren, das Flackern zwischen Emotion und Idee, den Moment, in dem ein Gedanke kippt und etwas Neues wird. Das ist menschlich. Das ist roh. Das ist unersetzlich.

Wir verblöden nicht, weil wir dümmer werden. Wir verblöden, weil wir vergessen, dass Denken schön sein kann. Dass es ein ästhetischer Akt ist, sich in etwas zu vertiefen. Dass es Mut braucht, langsam zu sein.

Der sanfte Tod des Denkens ist kein Ende – sondern ein Spiegel. Und vielleicht erkennen wir uns darin. Für einen Moment. Bevor das nächste Video startet.