Lumo AI ist der Versuch, Künstliche Intelligenz wieder dorthin zu rücken, wo sie für viele von uns hingehört: in den Dienst des Menschen – nicht in den Dienst der Datensammlung. Ein europäischer Chatbot, gebaut von einem Unternehmen, das seit Jahren Privatsphäre zur Chefsache erklärt. Kein Marketing‑Slogan, sondern ein Anspruch: Gespräche, die nicht mitgeschrieben werden. Kontexte, die nicht heimlich in Trainingsdaten rutschen. Eine Infrastruktur, die in Europa steht und damit europäischen Rechtsrahmen folgt. Genau das macht Lumo bemerkenswert in einem Markt, der sonst zu oft nach dem Prinzip „erst skalieren, dann nachdenken“ funktioniert.

Wenn man Lumo als kreativer, beratender oder technischer Profi nutzt, spürt man schnell die Leitentscheidungen hinter dem Produkt. Der Dienst speichert standardmäßig keine Chat‑Logs auf Servern, setzt auf Zero‑Access‑Verschlüsselung für gespeicherte Verläufe und verpflichtet sich sichtbar dazu, Nutzereingaben nicht für das Modelltraining zu verwenden. Das ist kein bequemes Detail am Rand, sondern ein Grundpfeiler: Ein Gespräch bleibt ein Gespräch – und kein Rohstoff. Für alle, die mit sensiblen Entwürfen, unveröffentlichten Konzepten, internen Briefings, juristischen Texten oder einfach mit persönlicher Lebensrealität arbeiten, bedeutet das: Man kann KI nutzen, ohne damit gleichzeitig die eigene Sphäre preiszugeben.

In der Praxis liest sich das so: Lumo fragt nicht nach deinem Leben, um es irgendwo abzuladen, sondern nach deiner Aufgabe, um sie zu erledigen. Du kannst Dokumente prüfen lassen, Ideen strukturieren, E‑Mails formulieren, Texte übersetzen, Informationen einordnen. All das, ohne dass im Hintergrund ein Schattenprotokoll entsteht. Wer mag, aktiviert einen Modus, in dem Chats lokal verschlüsselt in der Historie landen; wer noch konsequenter sein will, nutzt ein „Geist‑Profil“, in dem sich Gespräche nach der Sitzung verflüchtigen. Das Ergebnis ist nicht spektakulär im Sinne des Hypes, aber beruhigend im Sinne der Souveränität: Du sprichst mit einem System, das dir zuhört – und danach wieder schweigt.

Dass Lumo aus Europa kommt, ist mehr als Geografie. Es bedeutet, dass der Dienst sich in einen Rechtsraum einordnet, der Datenschutz nicht als Zugeständnis versteht, sondern als Pflicht. Die DSGVO ist keine perfekte, aber eine klare Leitplanke: Transparenz, Zweckbindung, Datenminimierung, Löschrechte. Ein KI‑Assistent, der in diesem Rahmen konstruiert wird, muss Nutzerkontrolle nicht künstlich aufmalen, sondern technisch herstellen. Dazu gehört, dass Funktionen, die Datenverkehr nach außen erzeugen – wie zum Beispiel Web‑Recherche – nicht ungefragt im Hintergrund laufen, sondern bewusst aktiviert werden. Dazu gehört auch, dass du Daten nicht nur „fortlaufend lieferst“, sondern aktiv entscheidest, wann, wo und wofür du sie gibst.

Als Fachmensch mit Blick für Systeme interessiert mich bei Lumo vor allem die Architektur der Entscheidungen. Zero‑Access‑Verschlüsselung heißt: Was lokal gespeichert wird, kann nur auf deinem Endgerät entschlüsselt werden. Die Betreiber selbst haben keinen Generalschlüssel, und ohne diesen bleibt der Inhalt mathematisch unzugänglich. No‑Logs heißt: Es existieren auf Servern keine Gesprächsaufzeichnungen, die sich aggregieren, profilieren oder abfragen ließen. Und „kein Training mit Nutzereingaben“ heißt: Das, was du hineinschreibst – Geschäftsidee, Code‑Snippet, medizinische Frage, Beziehungschaos – landet nicht in einem späteren Modell. Die Grenze zwischen „Produkt verbessern“ und „Nutzer auswerten“ bleibt so, wie sie sein muss: eine Grenze.

Natürlich hat diese Haltung einen Preis. Lumo ist nicht das „Feature‑Monster“, das jede Woche fünf neue Kunststücke lernt. Es ist nicht die Plattform, die alles gleichzeitig sein will: Bild‑ und Video‑Studio, Suchmaschine, Marktplatz, Agenten‑Ökosystem, Datenkrake. Wer auf maximale Multimodalität, verzahnten Cloud‑Speicher und unbegrenzte Integrationen hofft, bekommt bei Lumo (zumindest zum Start) eine nüchternere Antwort. Doch das ist kein Mangel, sondern eine Positionierung. Lumo verzichtet bewusst auf Mechanismen, die den Datenschutz verwässern könnten. Weniger ist hier mehr – sofern die Kernaufgaben, die ein Assistent leisten soll, zuverlässig funktionieren: klares Schreiben, präzises Zusammenfassen, nachvollziehbares Strukturieren, kompetentes Einordnen.

Für Teams und Unternehmen in Europa ergibt sich daraus ein pragmatischer Vorteil. Wer Compliance ernst nimmt, weiß: Es reicht nicht, eine Datenschutz‑Erklärung zu verfassen und ein Cookie‑Banner zu zeigen. Wenn Mitarbeitende operativ mit KI arbeiten, müssen die Werkzeuge zu den eigenen Regeln passen. Ein Assistent, der in Europa gehostet wird, keine Server‑Logs führt, Nutzereingaben nicht für Trainingszwecke verwendet und gespeicherte Verläufe nur clientseitig entschlüsselbar macht, reduziert systemisch das Risiko. Selbstverständlich ersetzt das keine gute Governance – aber es verschiebt die Ausgangslage in eine freundlichere Richtung. Du musst nicht mehr „gegen“ das Tool arbeiten, um es durch Richtlinien zu bändigen, sondern kannst „mit“ dem Tool arbeiten, weil es von sich aus datensparsam agiert.

Mich überzeugt auch, dass Lumo Privatsphäre nicht mit Paranoia verwechselt. Der Dienst will nicht die Welt abklemmen, sondern die Entscheidungen zurückgeben: Du steuerst, was geteilt wird – und wann. So wird Privatsphäre kein Stillstand, sondern eine Technik der Souveränität. Das unterscheidet „Privacy by Design“ von „Privacy by Marketing“. Ersteres zwingt die Architektur zu Disziplin: möglichst wenig erfassen, möglichst viel lokal lösen, klare Löschbarkeit, nachvollziehbare Transparenz, offene Komponenten dort, wo Überprüfbarkeit zentral ist.

Auf der anderen Seite sollten wir die rosa Brille absetzen. Auch ein europäischer Anbieter bleibt Teil einer Welt, in der Regulierung sich bewegt, in der politische Umgebungen schwanken und in der technische Umsetzung mehr ist als ein Slogan. Zero‑Access heißt, dass gespeicherte Verläufe sicher sind – aber Live‑Verarbeitung findet trotzdem auf Servern statt, und jeder Online‑Dienst muss sich DDoS‑Schutz, Missbrauchserkennung und Fehlerbehebung stellen, ohne dabei die eigenen Prinzipien zu verletzen. Es bleibt also Aufgabe der Betreiber, die Gratwanderung sauber zu gehen: genug Telemetrie, um einen Dienst stabil zu halten, aber nicht so viel, dass Profile, Muster oder Wiedererkennung möglich werden.

Für die künstlerische und strategische Praxis ist Lumo vor allem eins: ein Werkzeug, das beim Denken hilft, ohne mitzudenken, wer du bist. Du kannst es als Ideenpartner nutzen, ohne dich nackt zu machen. Du kannst Entwürfe entstehen lassen, ohne dass sie in eine Datenfabrik wandern. Du kannst heikle Kontexte bearbeiten – Krisenkommunikation, HR‑Angelegenheiten, juristische Erstbewertungen – und danach mit ruhigem Gewissen weitermachen. Das verändert die innere Haltung: Man tippt befreiter, weil man nicht bei jedem Satz im Hinterkopf hat, dass man hier womöglich sein zukünftiges Ich zitiert, wenn ein Leak oder ein Datenzugriff passiert.

Spannend ist, wie Lumo mit dem Thema Transparenz umgeht. Vieles am Produkt ist offen dokumentiert, die technische Ausrichtung schafft Überprüfbarkeit. Das ist wichtig, weil Vertrauen in diesem Feld nicht aus Treueschwüren entsteht, sondern aus Prüfbarkeit. Ein europäischer Chatbot, der sich an seine eigenen Prinzipien messen lässt, ist deshalb wertvoller als jedes noch so blumige Versprechen. Gerade in Zeiten, in denen sich KI‑Ökosysteme rasant entwickeln, ist die Fähigkeit, Kernwerte auch bei Funktionsausbau nicht zu verraten, entscheidend.

Womit wir bei der Zukunft sind. Lumo wird sich, wenn der Dienst wachsen will, weiterentwickeln müssen. Die naheliegenden Felder sind klar: bessere Modelle, robustere Kontexte, verlässliche Zitierfunktionen, souveräne Quellenauszüge, solide Tools für Teams. Ebenso naheliegend ist die Versuchung, „einfach noch ein bisschen“ mehr zu integrieren: Bildanalyse hier, Browser‑Automatisierung dort, ein Agenten‑Ökosystem dazwischen. Die Kunst wird darin liegen, die Privatsphäre nicht als Anstrich zu benutzen, sondern als Konstruktionsprinzip. Heißt: Jedes neue Feature muss sich an Datenminimierung messen lassen. Wo möglich, lokal. Wo nötig, kurzlebig. Wo unvermeidlich, mit granularer Kontrolle. So bleibt ein Assistent ein Assistent – und wird nicht zur Sammelstelle.

Für Nutzerinnen und Nutzer heißt das: klug bleiben. Privatsphäre ist eine gemeinsame Aufgabe. Wer Lumo nutzt, sollte sich dieselben Fragen stellen wie bei jedem anderen Werkzeug: Welche Daten gebe ich wirklich preis? Muss diese Datei hochgeladen werden – oder reicht ein Auszug? Muss eine Websuche laufen – oder genügt eine interne Umformulierung? Muss der Verlauf gespeichert werden – oder ist die einmalige Antwort genug? Eine datensparsame Plattform entfaltet ihr Potenzial erst, wenn die Arbeitsweise dazu passt.

Was die Schreib‑ und Denkleistung betrifft, ist Lumo bereits auf der praktischen Seite des Spektrums. Es formuliert präzise, strukturiert klar, bleibt oft angenehm sachlich. Wenn man dem System gute Prompts gibt – Kontext, Ziel, Einschränkungen –, liefert es nutzbare Entwürfe, die man mit fachlichem Blick rasch weiterverarbeiten kann. Entscheidend ist, dass die Antworten nicht als Endprodukt, sondern als Ausgangspunkt verstanden werden. Gerade hier spielt der Datenschutz in die Qualität hinein: Wenn der mentale Widerstand geringer ist, teilt man präzisere Details und bekommt dadurch präzisere Hilfestellung – ohne das Gefühl, einen Preis zu zahlen, der erst später sichtbar wird.

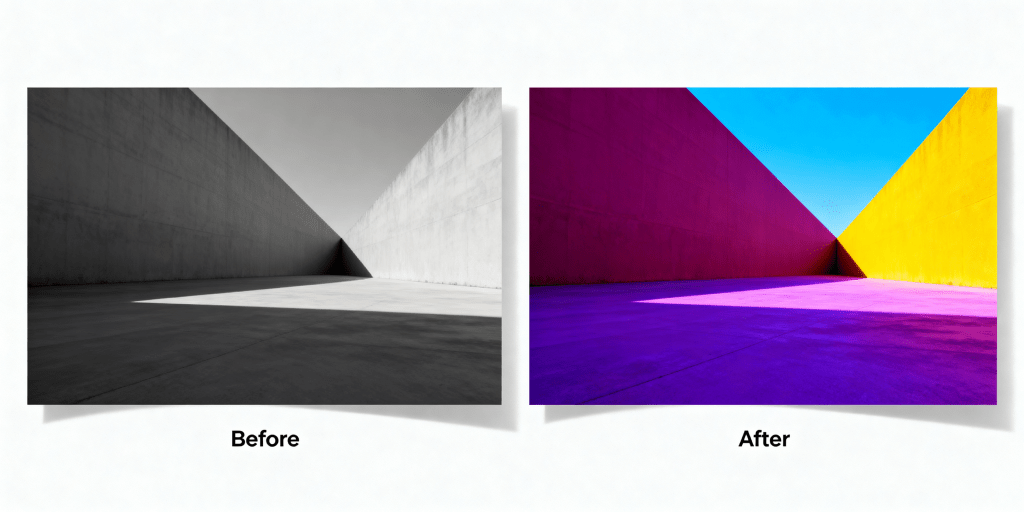

Ein Wort zur europäischen Perspektive: Viele Unternehmen und Solo‑Selbständige sind es leid, zwischen „mächtig, aber datenhungrig“ und „datensparsam, aber leistungsschwach“ zu wählen. Lumo zeigt, dass diese Dichotomie nicht naturgegeben ist. Man kann robuste Sprachmodelle nutzen und gleichzeitig klare Grenzen ziehen. Kein Training an Nutzereingaben bedeutet nicht: keine Lernfähigkeit. Es bedeutet: lernen an kuratierten, transparenten Quellen, an expliziten Feedback‑Schleifen, an offenen Modellen. Es ist aufwendiger, aber fairer – gegenüber den Menschen, deren Inhalte sonst zur unsichtbaren Beute würden.

Man kann, wenn man will, Lumo auch politisch lesen. Ein Dienst, der in Europa gehostet wird, der auf europäische Schutzprinzipien setzt, ist ein Statement gegen das „Daten zuerst, Rechte später“‑Paradigma. Er ist auch ein Statement gegen die bequeme Ausrede, Privatsphäre und Innovation seien Gegensätze. Sie sind es nicht. Sie stehen sich nur dann im Weg, wenn man Innovation als Deckmantel benutzt, um Daten ungefragt zu sammeln. Richtig verstanden, ist Datenschutz ein Innovationsmotor: Er zwingt uns, besser zu gestalten, präziser zu implementieren, bewusster zu entscheiden.

Bleibt die Frage: Für wen lohnt sich Lumo konkret? Für alle, die mit Vertrauen arbeiten. Für Kreative, die Skizzen und Konzepte nicht sofort in die Welt streuen wollen. Für Beraterinnen, die Kundengespräche und Marktanalysen nicht in Trainingspools wissen möchten. Für HR‑Teams, die sensible Fälle besprechen. Für Gründer, die den Pitch erst schärfen müssen. Für Juristinnen, die Formulierungen testen. Für Journalistinnen, die Fragen entwickeln. Für Lehrkräfte, die Materialien bauen. Kurz: Für alle, die das Gespräch mit einer Maschine wollen, ohne sich selbst zum Produkt zu machen.

Und was ist mit Geschwindigkeit und Funktionsfülle? Hier hilft Ehrlichkeit. Ja, es gibt Tools, die schneller, bunter, breiter sind. Ja, es gibt Modelle, die Bilder sehen, Videos deuten, Datenbanken crawlen, Dritt‑Apps steuern. Wer genau das braucht, wird andernorts vielleicht glücklicher. Aber die Kosten sind real: rechtlich, ethisch, kulturell. Wer Lumo wählt, entscheidet sich nicht gegen moderne KI, sondern für eine bestimmte Kultur ihrer Nutzung. Heute fühlt sich das noch wie Verzicht an; morgen könnte es sich als Standard anfühlen, wenn Regulierungen verschärft und Datenlecks weiter den Takt angeben.

Zum Schluss das Entscheidende: Lumo ist kein Heilsversprechen, sondern ein Angebot. Ein Werkzeug, das dir erlaubt, mit KI zu arbeiten, ohne dich selbst zur Ware zu machen. Ein Assistenzsystem, das Kompetenz anbietet, nicht Kontrolle. Ein Raum, in dem du experimentieren kannst, ohne deine Identität mitzuliefern. Für die europäische Tech‑Landschaft ist das ein gutes Zeichen: Wir können anders bauen. Wir können starke Werkzeuge liefern, die nicht durch die Hintertür schwach werden. Wenn wir diese Richtung halten – technisch, rechtlich, kulturell –, dann wird Privatsphäre nicht der Preis der Zukunft, sondern ihr Fundament.

Lumo AI steht dafür als Name, als Produkt, als Haltung. Es fordert uns auf, besser zu fragen: nicht nur „Was kann die KI?“, sondern „Was darf sie wissen?“. Die Antwort liegt in der Architektur. Und die Architektur ist, zumindest hier, auf deiner Seite.