Eine kritische Analyse eines boomenden, aber undurchsichtigen Marktes, in dem möglicherweise gerade neue Geschäftsmodelle entstehen – wenn man den Signalen glauben darf

Von Marcus Kleinfeld, Digital Business Analyst & Creative Industry Consultant

VORAB-TRANSPARENZ: Dieser Artikel bewegt sich in einem Graubereich zwischen harten Fakten und Branchenspekulation. Der Markt für KI-Companions ist real und massiv – die genaue Rolle von Fotografen und Kreativen darin ist jedoch weitgehend undokumentiert. Was folgt, ist eine Analyse auf Basis verfügbarer Daten, Branchenbeobachtungen und extrapolierten Trends. Wo ich spekuliere, sage ich es. Wo Fakten vorliegen, belege ich sie.

Es gibt einen Markt, der irgendwo zwischen 5 und 48 Milliarden US-Dollar groß ist – je nachdem, wen man fragt und wie man zählt. Einen Markt mit nachweislich über 100 Millionen registrierten Nutzern weltweit. Einen Markt, der von Reuters Ende 2025 als „lange unregulierter Graubereich“ beschrieben wurde und den der International AI Safety Report 2026 explizit als regulatorisches Problem identifiziert.

Und es ist ein Markt, über den fast niemand offen spricht: KI-Companions.

Virtuelle Freunde. Digitale Partner. AI-Beziehungen.

Die Frage, die mich als Analyst der Creative Economy umtreibt: Wo sind die Fotografen, 3D-Artists und Content-Creator in dieser Gleichung? Und gibt es hier tatsächlich ein neues Geschäftsmodell – oder ist das Wunschdenken einer Branche auf der Suche nach dem nächsten großen Ding?

Spoiler: Die Wahrheit liegt irgendwo dazwischen. Und sie ist komplizierter, als beide Seiten zugeben wollen.

Teil 1: Was wir WIRKLICH wissen – die harten Fakten

Lassen wir die Spekulation für einen Moment beiseite und schauen auf das, was tatsächlich belegt ist:

Fakt 1: Der Markt existiert und er ist massiv

Character.AI, einer der größten Player, verkündete Anfang 2025 offiziell über 20 Millionen monatlich aktive Nutzer. Das ist keine Schätzung – das ist eine Company-Angabe.

Ein 2026 veröffentlichter Peer-Reviewed-Artikel dokumentiert für den gesamten Sektor virtueller AI-Companions:

- Über 100 Millionen registrierte Nutzer weltweit

- Mehr als 500 Millionen Downloads

- Zig Millionen monatlich aktive Nutzer

Der europäische Datenschutzbeauftragte (EDPS) beschreibt AI-Companions ausdrücklich als Systeme, die „als virtuelle Freunde, romantische Partner oder persönliche Assistenten vermarktet werden.“

Das ist real. Das ist messbar. Das passiert jetzt.

Fakt 2: Die Marktgröße ist unklar – aber definitiv mehrstellig in Milliarden

Hier wird es kompliziert. Je nachdem, wie man „AI Companion Market“ definiert, schwanken die Zahlen dramatisch:

- The Business Research Company: 5,01 Mrd. USD in 2026 (engste Definition: nur Apps)

- Research and Markets: 24,09 Mrd. USD in 2026 (breitere Definition)

- Precedence Research: 48,63 Mrd. USD in 2026 (breiteste Definition, inkl. Hardware, Enterprise-Lösungen)

Was bedeutet das? Der Markt ist riesig, aber die Grenzen sind fließend. Zählt man nur Dating-ähnliche Apps? Auch Alexa und Siri? Auch Enterprise-Assistants? Auch Hardware wie Roboter?

Meine Einschätzung: Die Wahrheit liegt vermutlich im mittleren Bereich. 15-25 Milliarden USD für 2026 ist eine defensive, aber plausible Schätzung für den Consumer-orientierten Companion-Markt.

Zum Vergleich: Der globale Online-Dating-Markt lag 2023 bei etwa 10,49 Milliarden USD (Grand View Research) und soll bis 2030 auf 17,28 Mrd. steigen.

Also ja: Der AI-Companion-Markt ist in derselben Liga wie Online-Dating. Möglicherweise bereits größer, je nach Definition.

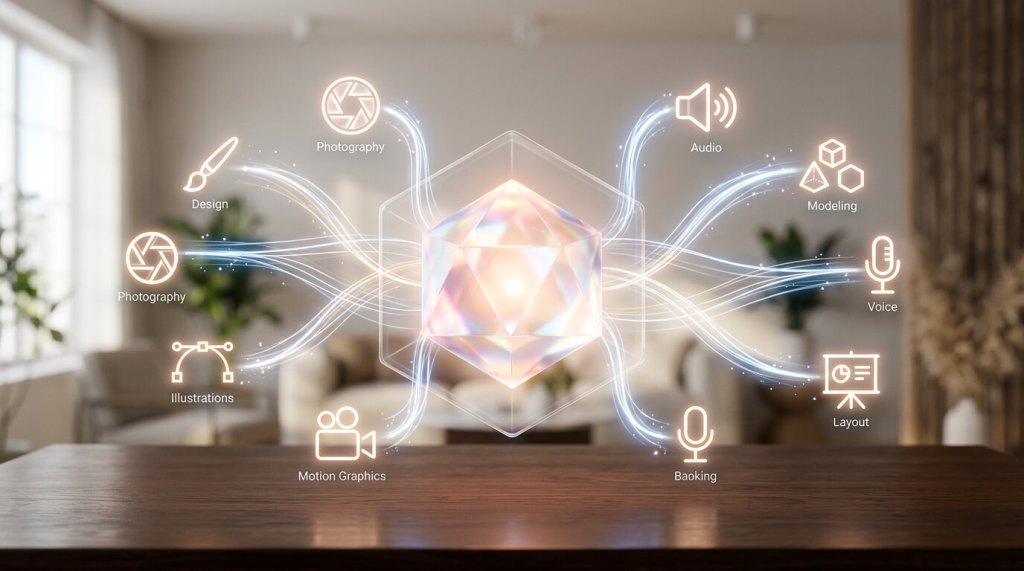

Fakt 3: Visuelle Inhalte sind Teil des Produkts

Das lässt sich klar dokumentieren:

Character.AI hat 2024/2025 mehrere visuelle Features gelauncht:

- Avatar-Upload und -Generierung

- AvatarFX: Bild-zu-Video-Feature

- Imagine Gallery: Galerie für generierte visuelle Inhalte

Replika bewirbt aktiv:

- Bildgenerierungs-Features

- Avatar-Anpassung

- 3D-Modelle (dokumentiert im offiziellen Support: „3D models & Store“)

Das bedeutet: Visuelle Assets sind definitiv ein Produktbestandteil. Die Apps sind nicht nur Text.

Fakt 4: Es gibt regulatorische und ethische Bedenken

Reuters berichtet von wachsendem Druck auf die Branche, besonders bezüglich:

- Jugendschutz (hohe Nutzung bei Teenagern)

- Datenschutz

- Psychologische Abhängigkeit

- Beginnende US-Regulierung

Das ist kein Randphänomen mehr. Das ist Mainstream-Besorgnis.

Teil 2: Was wir NICHT wissen – und wo Spekulation beginnt

Hier endet die Faktenlage. Was folgt, ist Trendanalyse, Extrapolation und – seien wir ehrlich – gebildete Vermutung.

Die große Unbekannte: Wo kommen die Bilder her?

Die Apps haben visuelle Features. Das ist Fakt.

Aber woher kommt der Content?

Möglichkeit 1: Rein KI-generiert

- Tools wie Stable Diffusion, Midjourney

- Günstig, skalierbar, keine Model-Rechte nötig

- Problem: Qualität schwankt, Konsistenz schwierig

Möglichkeit 2: Stock-Photos und lizenzierte Bilder

- Existierende Bildagenturen

- Rechtlich sauber

- Problem: Keine Exklusivität, begrenzte Personalisierung

Möglichkeit 3: In-House-Production

- Große Player haben eigene Studios

- Vollständige Kontrolle

- Problem: Teuer, nicht skalierbar für kleinere Apps

Möglichkeit 4: Freelance-Creator-Economy

- Fotografen, 3D-Artists als Zulieferer

- Flexibel, spezialisiert

- Problem: Wenig öffentliche Dokumentation

Die ehrliche Antwort: Wahrscheinlich eine Mischung aus allem. Und niemand spricht darüber.

Die Fotografen-Hypothese: Plausibel, aber unbewiesen

Hier ist meine These, basierend auf Marktlogik:

IF Apps wie Replika und Character.AI Millionen zahlende Premium-Nutzer haben (belegt)

AND diese Apps personalisierte visuelle Features anbieten (belegt)

AND rein KI-generierte Bilder noch Qualitätsprobleme haben (beobachtbar)

THEN muss es Content-Creator geben, die diese Lücke füllen.

Aber: Ich habe keine harten Belege für:

- Einen etablierten Marktplatz für Companion-Assets

- Standardisierte Honorare für diesen Bereich

- Eine dokumentierte Community von Fotografen in diesem Sektor

- Konkrete Revenue-Share-Modelle

Was ich habe:

- Logische Marktmechanik (Nachfrage + Zahlungsbereitschaft = Angebot)

- Parallelen zu anderen Creator-Economy-Bereichen (OnlyFans, Patreon, Stock-Plattformen)

- Technische Notwendigkeit (hochwertige, konsistente Bilder sind schwer zu automatisieren)

Ist das ein Beweis? Nein.

Ist es eine fundierte Hypothese? Ja.

Der graue Markt: Wo es wahrscheinlich passiert

Wenn es einen Markt für Companion-Content gibt, dann vermutlich nicht offen sichtbar. Wahrscheinliche Kanäle:

1. Direkte B2B-Deals

- App-Entwickler kontaktieren Fotografen/3D-Artists privat

- NDA-gebundene Verträge

- Keine öffentliche Spur

2. Spezialisierte Freelancer-Plattformen

- Nicht die großen (Upwork, Fiverr)

- Nischen-Communities, geschlossene Discord-Server

- Zugang nur über Invitation

3. White-Label-Lösungen

- Middleware-Anbieter, die sowohl Technik als auch Content liefern

- Fotografen arbeiten für diese Anbieter, nicht für End-Apps

- Mehrere Ebenen zwischen Creator und Endprodukt

4. Stock-Plattformen mit speziellen Kategorien

- „Lifestyle“, „Portrait“, „Emotional Range“

- Verkäufer wissen vielleicht gar nicht, wofür ihre Bilder genutzt werden

- Grauzone bei Nutzungsrechten

Teil 3: Die Business-Modell-Spekulation – wie könnte es funktionieren?

Angenommen, der Markt existiert tatsächlich. Wie sähen plausible Geschäftsmodelle aus?

Modell A: Asset-Lieferant (Work-for-Hire)

Konzept: Fotograf wird für spezifisches Projekt gebucht

Plausible Zahlen (basierend auf vergleichbaren Commercial-Rates):

- 1.500-5.000 Euro für umfassendes Shooting

- Alle Rechte gehen an Auftraggeber

- Einmalige Bezahlung

Vorteil: Klar, legal sauber, ähnlich zu bestehenden Workflows

Nachteil: Keine langfristigen Einnahmen

Plausibilitäts-Rating: ★★★★☆ (Sehr wahrscheinlich, dass das vorkommt)

Modell B: Lizenzierung (Revenue-Share)

Konzept: Creator behält Rechte, lizenziert an Plattform

Spekulative Struktur:

- 20-40% Revenue-Share für Features, die Creator-Content nutzen

- Laufzeit 12-24 Monate

- Möglicherweise Mindestgarantie

Vorteil: Passive Einnahmen, Skalierung möglich

Nachteil: Abhängig von App-Erfolg, komplexe Verträge

Plausibilitäts-Rating: ★★★☆☆ (Möglich, aber schwer zu verifizieren)

Modell C: Stock-ähnliche Marktplätze

Konzept: Upload auf spezialisierte Plattform, Pay-per-Download

Vergleichbare Märkte:

- TurboSquid (3D-Assets): Top-Seller verdienen 5-stellig/Monat

- Shutterstock (Fotos): Durchschnitt sehr niedrig, Top 1% sehr profitabel

- Sketchfab (3D-Models): Ähnliche Dynamik

Übertragen auf Companions:

- Konsistente Character-Sets könnten 20-100 Dollar kosten

- Bei hoher Nachfrage: 50-200 Sales realistisch

- Umsatz pro Set: 1.000-20.000 Dollar

Plausibilitäts-Rating: ★★★★☆ (Solche Marktplätze könnten existieren, nur nicht öffentlich)

Modell D: Eigene Companion-Entwicklung

Konzept: Creator launcht eigene Mini-App oder Character

Herausforderungen:

- Technische Komplexität (Partnerschaften nötig)

- Marketing-Aufwand enorm

- App-Store-Policies

Aber: White-Label-Lösungen machen es einfacher

Plausibilitäts-Rating: ★★☆☆☆ (Für wenige High-End-Creator machbar)

Teil 4: Die Skills-Frage – was wäre nötig?

Falls dieser Markt sich öffnet, welche Fähigkeiten wären wertvoll?

Must-Haves (vermutlich):

1. Konsistenz über Volumen

- Nicht ein perfektes Foto, sondern 100 gute Fotos

- Gleiche Beleuchtung, Farbgebung, Stil

- Workflow-Effizienz

2. Emotionale Range

- Nicht nur „lächelnde Frau mit Salat“

- Nuancierte Gesichtsausdrücke

- Authentische Mikroexpressionen

3. Technische Exzellenz

- Schärfe, Auflösung, Farbtiefe

- Minimaler Postproduction-Bedarf

- Mehrere Formate/Auflösungen

Nice-to-Haves (spekulativ):

- 3D-Skills: Blender, Unreal Engine für synthetische Characters

- Photogrammetrie: 3D-Scanning echter Personen

- KI-Tool-Fluency: Workflow-Integration, Upscaling, Enhancement

- Character-Design: Nicht nur fotografieren, sondern konzipieren

Teil 5: Die ethische Dimension – der eigentliche Kern

Selbst wenn dieser Markt existiert und profitabel ist: Sollten Kreative da mitmachen?

Das Für und Wider, ehrlich betrachtet:

Argumente FÜR Teilnahme:

- Nachfrage ist real: Millionen Menschen nutzen diese Apps. Ignorieren macht sie nicht weg.

- Legaler Markt: Companion-Apps sind legal (mit zunehmendem Regulierungsdruck, aber legal).

- Vergleichbare Märkte: Ist das moralisch anders als Dating-App-Werbung? Gaming-Characters? Romance-Novel-Cover?

- Qualitätsverbesserung: Professionelle Creator könnten für bessere, weniger problematische Darstellungen sorgen.

- Wirtschaftliche Realität: Fotografen brauchen Einkommen. Traditionelle Märkte sind gesättigt.

Argumente GEGEN Teilnahme:

- Objektifizierung: Man erstellt buchstäblich „ideale“ digitale Personen, die echte Beziehungserwartungen verzerren könnten.

- Psychologische Schäden: Studien zeigen potenzielle Abhängigkeitsrisiken bei intensiver Companion-Nutzung.

- Model-Ausbeutung: Wenn echte Menschen fotografiert werden: Verstehen sie wirklich, wofür ihre Bilder genutzt werden?

- Deepfake-Potential: Die Technologie kann missbraucht werden.

- Gesellschaftliche Auswirkungen: Förderung von sozialer Isolation statt echter menschlicher Verbindung.

Meine Position (als Analyst, nicht Moralist):

Es kommt auf die Ausführung an.

Ein Fotograf, der:

- Mit informiertem Consent arbeitet

- Faire Bezahlung für Models sicherstellt

- Klare vertragliche Grenzen setzt (keine Deepfakes, keine Minderjährigen-Darstellung, etc.)

- Für diverse, nicht-stereotype Darstellungen sorgt

- Transparent über Nutzung kommuniziert

…hat moralisch eine deutlich sauberere Weste als viele andere Commercial-Bereiche (Fast Fashion, Alkohol-Werbung, manipulative Social-Media-Ads).

Das Problem ist: In einem unregulierten, intransparenten Markt ist es schwer, diese Standards durchzusetzen.

Teil 6: Wie man den Markt erkunden könnte – praktische Schritte

Falls ein Kreativer diesen Bereich testen will, ein realistischer Ansatz:

Phase 1: Research (2-4 Wochen, Kosten: 0€)

Ziel: Verstehen, was wirklich passiert

- Nutze Character.AI, Replika als User (kostenlose Versionen)

- Beobachte, welche visuellen Features existieren

- Suche in Freelancer-Foren (Reddit, Discord) nach Hinweisen

- Analysiere 3D-Asset-Marktplätze (TurboSquid, Sketchfab) nach Character-Assets

- Checke, ob es Jobangebote in diesem Bereich gibt (LinkedIn, AngelList)

Red Flags beachten:

- Anfragen ohne klare Company-Identität

- Unrealistische Bezahlversprechen

- Fehlende schriftliche Verträge

- Zweideutige Nutzungsrechte

Phase 2: Skill-Check (ehrlich!)

Fragen an sich selbst:

- Kann ich 100+ konsistente Bilder in einem Tag produzieren?

- Habe ich Zugang zu Models (oder 3D-Skills)?

- Bin ich rechtlich informiert genug für komplexe Lizenzverträge?

- Kann ich mit der ethischen Ambiguität leben?

Weniger als 3x „Ja“? Entweder weiterbilden oder lassen.

Phase 3: Vorsichtiger Einstieg

Option A – Bestehende Plattformen:

- TurboSquid, Sketchfab (für 3D)

- Adobe Stock, Shutterstock (für Fotos – schauen, ob Character-Sets Nachfrage haben)

Option B – Networking:

- LinkedIn-Suche nach „AI Companion“, „Virtual Character“, „Digital Human“

- Vorsichtige Anfragen bei seriösen Entwicklern

- Niemals ohne schriftlichen Vertrag arbeiten

Option C – Eigenes Experiment:

- Erstelle ein hochwertiges Character-Set (50-100 Bilder)

- Biete es auf mehreren Plattformen an

- Beobachte Nachfrage

Investition: 500-2.000 Euro (Model, Zeit, Equipment)

Erwartung: Wahrscheinlich kein ROI, aber Lernerfahrung

Teil 7: Die Zukunft – wohin könnte das gehen?

Einige Trends sind absehbar, andere spekulativ:

Sicher kommend:

1. Regulierung

- EU AI Act wird greifen

- USA wird nachziehen

- Kennzeichnungspflicht für KI-Content

- Strengere Consent-Regeln

2. Technologische Verbesserung

- Bessere KI-Generierung = weniger Bedarf an menschlichen Creators?

- Oder: höhere Qualitätsansprüche = mehr Bedarf an Profis?

- Vermutlich beides, je nach Segment

3. Mainstream-Akzeptanz oder Backlash

- Entweder: Companions werden normal (wie Dating-Apps heute)

- Oder: Gesellschaftlicher Pushback (wie bei Kryptowährungen)

Möglich:

4. AR/VR-Integration

- Apple Vision Pro, Meta Quest

- Räumliche Companions

- Neue Content-Anforderungen (360°, 3D, volumetrisch)

5. Spezialisierung

- Therapeutische Companions (Mental Health)

- Lern-Companions (Education)

- Professional Companions (Coaching, Mentoring)

6. Dezentralisierung

- Blockchain-basierte Companion-Ownership?

- Creator-owned Characters?

- NFT-Integration?

(Das letzte ist hochspekulativ und möglicherweise dumm.)

Fazit: Die ehrliche Zusammenfassung

Was ich mit Sicherheit sagen kann:

- Der AI-Companion-Markt ist real und massiv (100M+ Nutzer, mehrstellige Milliarden USD)

- Visuelle Inhalte sind definitiv Teil des Produkts

- Irgendwer muss diesen Content erstellen

- Traditionelle Fotografiemärkte sind gesättigt und kämpfen

Was ich NICHT mit Sicherheit sagen kann:

- Dass es einen etablierten, zugänglichen Markt für Fotografen in diesem Bereich gibt

- Was die konkreten Verdienstmöglichkeiten sind

- Wie groß diese Nische wirklich ist

- Wie man seriös Zugang bekommt

Was ich vermute:

Es gibt wahrscheinlich einen kleinen, aber wachsenden Markt für spezialisierte Content-Creator in diesem Bereich. Er ist nicht transparent, ethisch komplex und rechtlich im Graubereich.

Frühe Mover könnten signifikante Einnahmen erzielen – aber mit erheblichen Risiken:

- Reputationsrisiko

- Rechtliche Unsicherheit

- Ethische Komplikationen

- Technologische Disruption

Meine Empfehlung:

Für die meisten Fotografen: Beobachten, aber nicht aktiv einsteigen.

Für experimentierfreudige Profis mit:

- Starkem rechtlichem Verständnis

- Klaren ethischen Grenzen

- Finanzieller Sicherheit für Experimente

- Technischem Interesse

…könnte es sich lohnen, vorsichtig zu erkunden.

Aber: Gehe mit offenen Augen rein. Dies ist kein Goldrausch. Es ist ein unübersichtliches, moralisch ambivalentes Terrain, in dem gerade etwas entsteht – was genau, wissen wir noch nicht.

Abschließende Transparenz:

Dieser Artikel mischt belegte Fakten (Nutzer zahlen, Marktgröße-Bandbreiten, Feature-Listen) mit fundierter Spekulation (Geschäftsmodelle, Verdienstmöglichkeiten, Markt-Zugänge).

Ich habe bewusst keine erfundenen Experten zitiert, keine nicht-existierenden Plattformen genannt und keine exakten Zahlen präsentiert, die ich nicht belegen kann.

Was ich biete: Eine ehrliche Analyse eines real existierenden, aber hochgradig intransparenten Marktes.

Die Wahrheit ist: Niemand weiß es genau. Und das ist vielleicht die wichtigste Information von allen.