Einleitung: Spielentwicklung für alle

Stell dir vor, du hast eine Idee für ein Spiel. Kein großes Studio, keine Programmierkenntnisse, keine Crew von Entwicklern – und trotzdem entsteht daraus ein echtes, spielbares Game. Klingt wie Zukunftsmusik? Mit Gambo AI ist das Realität geworden.

Diese Plattform eröffnet eine neue Welt für Kreative, Hobby-Entwickler, Lehrer, Künstler – kurz: für alle, die schon immer eigene Spiele erschaffen wollten, ohne sich durch endlose Codezeilen zu kämpfen.

1. Was ist Gambo AI? – Der einfache Einstieg in die Spieleentwicklung

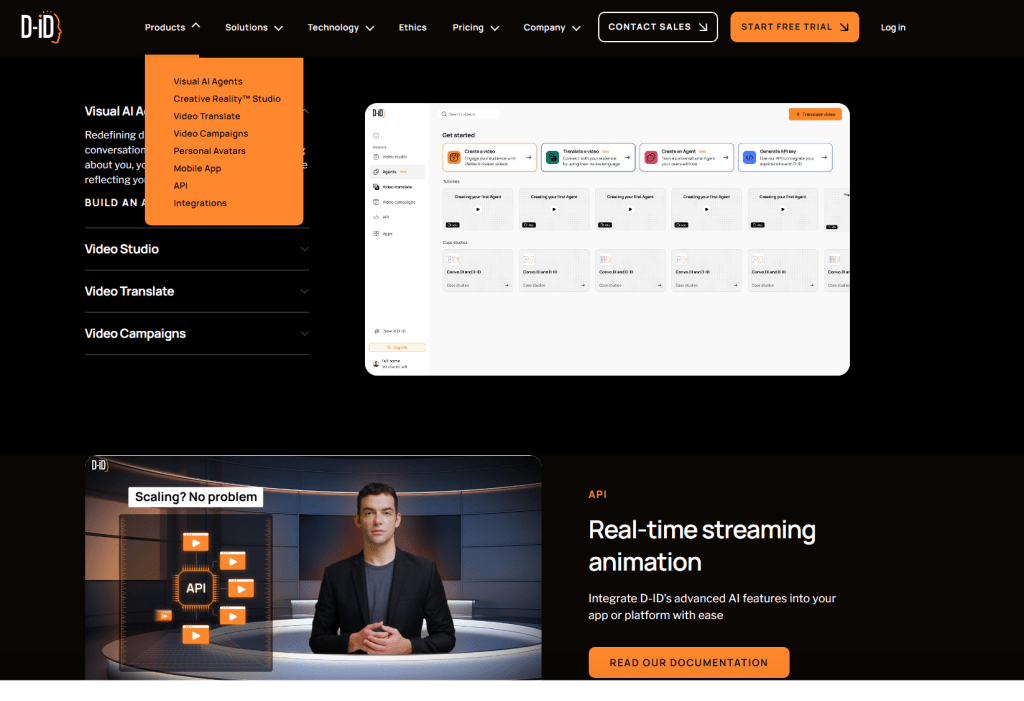

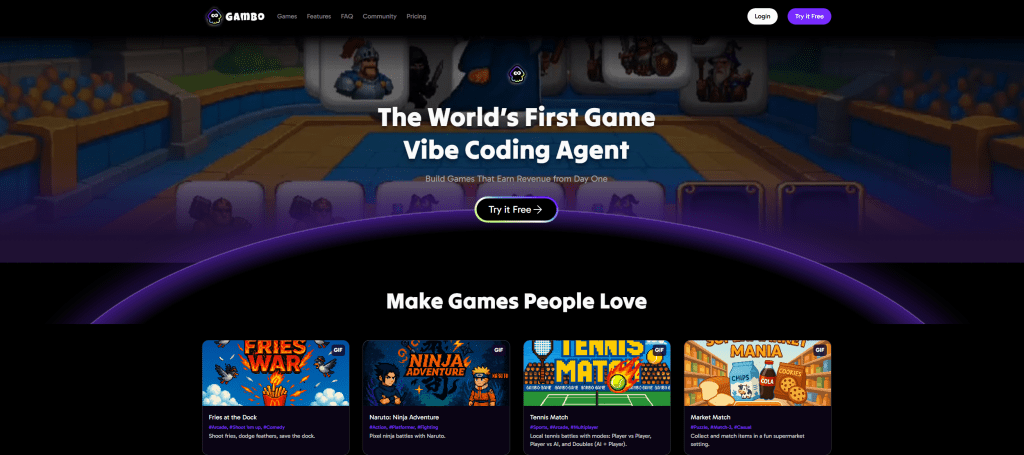

Gambo AI bezeichnet sich selbst als „The world’s first AI Game Builder and no-code game maker“. Hinter dieser Beschreibung steckt ein System, das mithilfe von künstlicher Intelligenz komplette Spiele generiert – ganz ohne Programmierung.

Ein paar Klicks genügen, und schon werden:

- Spiellogik erstellt

- Grafiken und Animationen generiert

- Sounds und Musik hinzugefügt

- Level-Strukturen automatisch erzeugt

Das Ziel: Spieleentwicklung so einfach wie das Erstellen einer Präsentation zu machen.

Die Plattform verspricht: „Create, publish and monetize your game in minutes.“ Und genau das ist der Unterschied zu klassischen Tools wie Unity oder Unreal Engine, die monatelange Einarbeitung erfordern.

2. Warum ist das gerade jetzt spannend?

Wir leben in einer Zeit, in der KI nicht mehr nur Assistent ist, sondern Mitgestalter. Gambo AI steht exemplarisch für diesen Wandel: Technologie, die kreative Arbeit nicht ersetzt, sondern erweitert.

Vier Gründe, warum das Timing perfekt ist:

- Barrieren verschwinden – Kein Code, kein Fachwissen, keine Hürden.

- Schneller Prototyping-Zyklus – Ideen lassen sich in Stunden statt Wochen umsetzen.

- Mehr kreative Freiheit – Die Technik kümmert sich um das Wie, der Mensch um das Was.

- Neue Märkte entstehen – Spiele werden überall gebraucht: im Marketing, in der Bildung, in der Kunst.

Gambo AI trifft damit einen Nerv. Wer heute ein Spiel entwickelt, braucht nicht mehr zwingend ein Team – nur noch eine Idee.

3. So funktioniert Gambo AI Schritt für Schritt

Wer Gambo AI ausprobieren will, findet auf der Website (https://www.gambo.ai/) eine intuitive Oberfläche. So läuft der Prozess:

- Anmelden & Plan wählen

Der kostenlose Plan erlaubt es, ein erstes Spiel zu erstellen und zu testen. - Idee eingeben oder Vorlage wählen

Ein Textfeld genügt: „Ein Weltraumspiel, in dem man Asteroiden ausweicht und Sterne sammelt.“ Schon generiert das System ein Grundgerüst. - Assets automatisch generieren

Grafiken, Animationen, Musik – alles KI-basiert. Nutzer können aber auch eigene Dateien hochladen. - Spielregeln anpassen

Ohne Programmierkenntnisse: „Springe mit Leertaste“, „Erhalte Punkte für jedes gesammelte Objekt“ – das System versteht natürliche Sprache. - Testen, verfeinern, veröffentlichen

Direkt im Browser anspielbar. Sobald es gefällt, lässt sich das Spiel teilen oder sogar monetarisieren.

4. Wo Gambo AI glänzt

Für Kreative:

Gambo AI ist ein Experimentierfeld. Die Plattform ermöglicht, Storytelling und visuelle Gestaltung in interaktive Form zu bringen – ohne technische Barrieren.

Für Lehrkräfte:

Lernspiele lassen sich einfach und schnell erstellen. Schüler können Ideen umsetzen, ohne an der Technik zu scheitern.

Für Unternehmen:

Interaktive Werbespiele, Produkt-Tutorials oder Brand Experiences sind in wenigen Stunden umsetzbar.

Für Indie-Entwickler:

Wer schon Erfahrung hat, kann Gambo nutzen, um Ideen zu testen oder Prototypen zu präsentieren.

5. Chancen für die Kreativszene

Was Canva für Grafikdesign ist, könnte Gambo AI für Spiele werden.

- Demokratisierung der Spielentwicklung: Jeder kann entwickeln, nicht nur Programmierer.

- Kreative Expansion: Künstler können mit Spielmechaniken experimentieren – z. B. emotionale Erfahrungen erschaffen.

- Schnelle Ideenumsetzung: Kreative Konzepte werden sofort testbar.

- Globale Kollaboration: Projekte können gemeinsam bearbeitet werden – völlig ortsunabhängig.

Damit wird Spielentwicklung nicht mehr nur technischer Prozess, sondern kreativer Ausdruck.

6. Die Grenzen – wo Gambo (noch) aufhört

Natürlich ist nicht alles perfekt.

- Begrenzte Komplexität: Für einfache Spiele großartig, für komplexe 3D-Welten eher ungeeignet.

- Wiedererkennbare KI-Ästhetik: Manche generierte Grafiken wirken generisch.

- Monetarisierung mit Vorsicht: Gambo bietet Werbefunktionen, aber keine Erfolgsgarantie.

- Rechte & Transparenz: Wie bei jeder KI gilt: Nutzungsrechte und Quellen prüfen.

Trotzdem gilt: Die Einstiegshürde war nie niedriger – und das ist revolutionär.

7. Ein Beispiel: Vom Gedanken zum Game

Nehmen wir eine einfache Idee: „Ein kleiner Vogel fliegt durch eine verlassene Stadt und muss Erinnerungen einsammeln.“

Mit Gambo AI:

- Beschreibung eintippen.

- Assets generieren lassen (Stadt, Vogel, Lichtpartikel).

- Regeln festlegen (Fliegen, Sammeln, Punkte).

- Spiel testen – fertig.

In weniger als einer Stunde entsteht ein fertiges, spielbares Kunstwerk. Keine Zeile Code. Kein Frust.

8. Der kulturelle Impact

Gambo AI ist mehr als ein Tool. Es ist ein Zeichen, dass Kreativität neu definiert wird.

Früher: „Ich kann nicht programmieren.“

Heute: „Ich kann’s einfach ausprobieren.“

Diese Haltung verändert ganze Industrien. Sie verschiebt Machtverhältnisse: vom Spezialisten zum Gestalter, vom Technikfokus zur Idee.

So wie Fotografie einst Malerei herausforderte, fordert KI jetzt klassische Entwicklung heraus – und eröffnet dabei neue Formen von Kunst.

9. Der Blick nach vorn

Die Vision ist klar: Spieleentwicklung wird so selbstverständlich wie Content Creation.

Künftig könnten wir:

- Spiele direkt aus Chatbots heraus generieren.

- Dynamische Kunstwerke erschaffen, die sich in Echtzeit anpassen.

- KI-gestützte Welten bauen, die Geschichten selbst weiterspinnen.

Gambo AI steht am Anfang dieser Entwicklung. Es ist nicht das Ziel – es ist der Startpunkt einer neuen Ära.

Fazit: Jeder kann Spielentwickler sein

Gambo AI ist ein Mutmacher für alle, die ihre Ideen endlich spielbar machen wollen. Es senkt Hürden, eröffnet neue kreative Wege und zeigt, dass Technologie nicht trennen muss, sondern verbinden kann.

Ob Künstler, Lehrer, Designer oder neugieriger Anfänger – Gambo AI bietet Raum zum Experimentieren.

Und vielleicht entsteht das nächste große Indie-Game nicht in einem Studio, sondern auf deinem Laptop – zwischen Kaffee, Neugier und einem Klick auf „Generate Game“.

Mehr über die Plattform erfährst du hier: https://www.gambo.ai/