Einleitung: Eine Branche im Umbruch

Die Fotografie hat in ihrer knapp zweihundertjährigen Geschichte zahlreiche Revolutionen erlebt. Von der Daguerreotypie zur Rollfilmkamera, vom Schwarz-Weiß zum Farbfilm, von analog zu digital – jede dieser Umwälzungen hat die Branche grundlegend verändert und mit ihr die Rolle des Fotografen. Doch was wir gerade erleben, übertrifft alle bisherigen Transformationen in Geschwindigkeit und Tragweite.

Künstliche Intelligenz ist nicht mehr Zukunftsmusik. Sie ist Gegenwart. Sie steckt bereits in unseren Smartphones, in professionellen Kameras, in jeder gängigen Bildbearbeitungssoftware. Und sie entwickelt sich mit einer Geschwindigkeit weiter, die selbst Experten überrascht. Was gestern noch Science-Fiction war, ist heute Alltag. Was heute beeindruckt, wird morgen selbstverständlich sein.

Für Fotografen stellt sich eine existenzielle Frage: Wird KI uns überflüssig machen? Die kurze Antwort lautet: Nein. Die längere Antwort ist komplexer und erfordert ein tiefes Verständnis dessen, was KI kann, was sie nicht kann, und wie Fotografen diese Technologie zu ihrem Vorteil nutzen können. Dieser Artikel bietet genau dieses Verständnis. Er beleuchtet die aktuellen Entwicklungen, analysiert ihre Auswirkungen auf verschiedene Bereiche der Fotografie und liefert konkrete Strategien für Fotografen, die nicht nur überleben, sondern in dieser neuen Ära gedeihen wollen.

Teil 1: Die KI-Revolution in der Fotografie – Was sich verändert

Smartphone-Kameras: Der erste Dominostein

Die KI-Revolution in der Fotografie begann nicht in professionellen Studios, sondern in unseren Hosentaschen. Moderne Smartphones nutzen komplexe KI-Algorithmen, um physikalische Grenzen ihrer winzigen Sensoren zu überwinden. Computational Photography heißt das Zauberwort, und es hat die Erwartungen an Bildqualität fundamental verändert.

Wenn Sie heute mit einem aktuellen iPhone oder Samsung-Gerät ein Foto bei schlechten Lichtverhältnissen aufnehmen, passiert weit mehr als ein einfacher Klick. Die KI kombiniert mehrere Aufnahmen, reduziert Rauschen, schärft Details, optimiert Farben und Kontraste – alles in Bruchteilen einer Sekunde. Das Ergebnis sind Bilder, die vor zehn Jahren eine teure Spiegelreflexkamera mit erfahrenem Fotografen erfordert hätten.

Diese Demokratisierung der Bildqualität hat weitreichende Folgen. Millionen von Menschen machen täglich Fotos, die technisch einwandfrei sind. Der Unterschied zwischen einem Smartphone-Schnappschuss und einem Profifoto ist geschrumpft. Für Fotografen bedeutet das: Technische Perfektion allein reicht nicht mehr als Verkaufsargument. Die Messlatte liegt höher.

Bildbearbeitung: Photoshop und darüber hinaus

Adobe Photoshop, seit Jahrzehnten das Standardwerkzeug professioneller Bildbearbeitung, hat sich durch KI grundlegend verändert. Funktionen wie Neural Filters, Content-Aware Fill und die neueste generative Füllung ermöglichen Bearbeitungen, die früher Stunden dauerten, in Sekunden. Himmel austauschen? Ein Klick. Störende Objekte entfernen? Die KI erledigt das. Gesichter retuschieren? Automatisch.

Lightroom nutzt KI für automatische Maskierung, intelligente Farbkorrekturen und die Kategorisierung von tausenden Bildern nach Inhalt. Capture One, Luminar und andere Konkurrenten ziehen nach. Die Einstiegshürde für professionelle Bildbearbeitung sinkt rapide. Was früher jahrelange Erfahrung erforderte, kann heute von der Software übernommen werden.

Für professionelle Retuschierer ist das eine zweischneidige Entwicklung. Einerseits können sie effizienter arbeiten. Andererseits können nun auch Amateure Ergebnisse erzielen, die früher nur Profis vorbehalten waren. Der Wettbewerb verschärft sich.

Generative KI: Bilder aus dem Nichts

Der dramatischste Umbruch kommt von Systemen wie Midjourney, DALL-E und Stable Diffusion. Diese generativen KI-Modelle können fotorealistische Bilder erzeugen, die nie aufgenommen wurden. Ein Model, das nicht existiert, vor einem Hintergrund, den es nie gab, mit einer Beleuchtung, die nie gesetzt wurde.

Für Stock-Fotografie ist das ein Erdbeben. Warum sollte eine Werbeagentur ein Fotoshooting mit Models buchen, wenn sie das gewünschte Bild in Minuten generieren kann? Warum sollte ein Unternehmen einen Fotografen für Produktfotos engagieren, wenn die KI das Produkt in jeder erdenklichen Szene platzieren kann?

Die ersten Auswirkungen sind bereits sichtbar. Stock-Agenturen berichten von sinkenden Verkaufszahlen für generische Bilder. Fotografen, deren Geschäftsmodell auf austauschbaren Aufnahmen basierte, spüren den Druck. Doch wie wir sehen werden, ist das nicht das Ende der Geschichte.

Kamera-Technologie: Intelligenz im Gehäuse

Auch die Kamerahersteller integrieren zunehmend KI in ihre Geräte. Sony, Canon und Nikon nutzen maschinelles Lernen für Autofokus-Systeme, die Augen von Menschen und Tieren in Echtzeit verfolgen. Belichtungsmessung und Weißabgleich werden von Algorithmen optimiert, die aus Millionen von Bildern gelernt haben.

Die neuesten Entwicklungen gehen noch weiter. Kameras, die automatisch den besten Moment für die Aufnahme wählen. Systeme, die verwackelte Bilder in Echtzeit korrigieren. Software, die bereits in der Kamera eine komplexe HDR-Entwicklung durchführt. Die Grenze zwischen Aufnahme und Bearbeitung verschwimmt.

Für Fotografen bedeutet das einerseits Erleichterung: Die Technik steht weniger im Weg, die Erfolgsquote steigt. Andererseits stellt sich die Frage: Wenn die Kamera immer mehr Entscheidungen trifft, was bleibt dann noch als Kernkompetenz des Fotografen?

Teil 2: Die Grenzen der KI – Warum Fotografen nicht überflüssig werden

Das Unersetzbare: Der menschliche Blick

Trotz aller technologischen Fortschritte gibt es Aspekte der Fotografie, die KI nicht ersetzen kann. An erster Stelle steht der menschliche Blick – die Fähigkeit, einen besonderen Moment zu erkennen, eine Geschichte zu sehen, wo andere nur Alltag wahrnehmen.

Ein Hochzeitsfotograf weiß instinktiv, wann der Bräutigam seine Nervosität zeigt, wann die Großmutter eine Träne unterdrückt, wann das Blumenmädchen müde wird. Dieses emotionale Gespür, diese Antizipation von Momenten, kann keine KI reproduzieren. Sie kann Gesichter erkennen, aber nicht die Bedeutung eines Blickwechsels.

Die großen Fotografen der Geschichte – Henri Cartier-Bresson, Annie Leibovitz, Sebastião Salgado – wurden nicht für ihre technische Perfektion berühmt, sondern für ihre einzigartige Perspektive auf die Welt. Diese Perspektive ist das Ergebnis eines menschlichen Lebens, einer persönlichen Geschichte, eines individuellen Blicks. Sie ist unersetzbar.

Authentizität und Vertrauen

In einer Welt, in der KI jedes Bild erzeugen kann, wird Authentizität zum kostbaren Gut. Menschen wollen wissen, dass ein Bild echt ist, dass es einen realen Moment festhält, dass jemand tatsächlich dort war und auf den Auslöser gedrückt hat.

Dieser Wunsch nach Authentizität zeigt sich bereits in verschiedenen Bereichen. Nachrichtenagenturen betonen ihre Richtlinien gegen KI-generierte Bilder. Marken werben mit echten Menschen statt perfekten KI-Models. Kunden fragen gezielt nach unbearbeiteten Rohbildern, um die Echtheit zu verifizieren.

Für Fotografen ist das eine Chance. Wer dokumentieren kann, wer echte Momente einfängt, wer Vertrauen aufbaut, hat einen Vorteil gegenüber jeder KI. Die Rolle des Fotografen als Zeuge, als Chronist der Realität, gewinnt an Bedeutung.

Beziehungen und menschliche Interaktion

Fotografie ist oft ein zutiefst menschlicher Prozess. Ein Porträtfotograf baut eine Beziehung zum Model auf, schafft Vertrauen, lockt authentische Emotionen hervor. Ein Eventfotograf interagiert mit Gästen, findet Zugang zu scheuen Personen, orchestriert Gruppenfotos. Ein Hochzeitsfotograf begleitet ein Paar durch einen der wichtigsten Tage ihres Lebens.

Diese menschliche Dimension kann keine KI ersetzen. Ein Roboter kann kein nervöses Model beruhigen. Ein Algorithmus kann keine Chemie zwischen Fotograf und Porträtiertem erzeugen. Die zwischenmenschlichen Fähigkeiten von Fotografen werden nicht obsolet – im Gegenteil, sie werden wichtiger.

Kreative Vision und Konzeptentwicklung

Vor jeder gelungenen Fotografie steht eine kreative Vision. Was soll das Bild aussagen? Welche Stimmung soll es vermitteln? Wie passt es in eine größere Geschichte oder Kampagne? Diese konzeptionelle Arbeit ist genuin menschlich.

Wenn ein Fotograf für eine Modemarke arbeitet, bringt er nicht nur technisches Können mit, sondern ein Verständnis von Trends, von Markenidentität, von Zielgruppen. Er entwickelt ein Konzept, das über das einzelne Bild hinausgeht. Diese kreative Direktion bleibt eine menschliche Domäne.

Teil 3: Was Fotografen jetzt wissen und können müssen

Technologische Kompetenz entwickeln

Der erste und wichtigste Schritt für Fotografen ist die Auseinandersetzung mit der neuen Technologie. Ignorieren ist keine Option. Wer die Werkzeuge nicht kennt, kann sie weder nutzen noch sich von ihnen abheben.

Lernen Sie die KI-Funktionen Ihrer Bearbeitungssoftware kennen. Experimentieren Sie mit generativen Tools wie Midjourney oder Adobe Firefly. Verstehen Sie, was diese Systeme können und wo ihre Grenzen liegen. Nur wer die Technologie beherrscht, kann fundiert entscheiden, wann er sie einsetzt und wann nicht.

Diese technologische Kompetenz wird zunehmend zum Wettbewerbsvorteil. Kunden schätzen Fotografen, die effizient arbeiten, die moderne Workflows beherrschen, die das Beste aus allen verfügbaren Werkzeugen herausholen können.

KI als Werkzeug integrieren

Die erfolgreichsten Fotografen werden nicht diejenigen sein, die KI ablehnen, sondern diejenigen, die sie geschickt in ihren Workflow integrieren. Dabei gibt es zahlreiche sinnvolle Anwendungsbereiche, die die Arbeit erleichtern, ohne die kreative Kontrolle abzugeben.

In der Bildbearbeitung kann KI zeitaufwendige Routinearbeiten übernehmen: automatische Selektion von Haaren, Entfernung von Hautunreinheiten, Austausch von langweiligen Himmeln. Was früher Stunden dauerte, ist in Minuten erledigt. Diese Effizienzgewinne können Sie nutzen, um mehr Zeit für die wirklich kreativen Aspekte zu haben.

In der Bildverwaltung hilft KI bei der Kategorisierung und Verschlagwortung großer Bildmengen. Gesichtserkennung, Szenen-Klassifizierung und automatische Bewertung beschleunigen den Auswahlprozess erheblich. Für Fotografen mit großen Archiven ist das Gold wert.

Auch in der Konzeptionsphase kann KI wertvolle Dienste leisten. Nutzen Sie generative Tools, um schnell Moodboards zu erstellen, Beleuchtungsideen zu visualisieren oder verschiedene Szenarien durchzuspielen, bevor das eigentliche Shooting beginnt.

Die eigene Nische schärfen

In einer Welt, in der generische Bilder von KI erzeugt werden können, wird Spezialisierung überlebenswichtig. Fotografen müssen ihre einzigartige Nische finden und konsequent besetzen.

Diese Nische kann stilistisch sein: ein unverkennbarer Bearbeitungsstil, eine besondere Art der Komposition, ein charakteristischer Umgang mit Licht. Sie kann thematisch sein: Spezialisierung auf Unterwasserfotografie, Architekturfotografie, Dokumentation bedrohter Kulturen. Oder sie kann auf besonderen Fähigkeiten basieren: technisches Wissen über komplexe Blitzsysteme, Erfahrung in extremen Umgebungen, besondere Menschenkenntnisse.

Wichtig ist, dass diese Nische authentisch ist und echten Mehrwert bietet. Fragen Sie sich: Was kann ich, was eine KI nicht kann? Was macht meine Bilder unverwechselbar? Warum sollte ein Kunde mich buchen statt eines günstigeren Alternativen?

Persönliche Marke aufbauen

In einer Welt austauschbarer Bilder wird die Person hinter der Kamera zum Unterscheidungsmerkmal. Kunden buchen nicht mehr nur Fotos – sie buchen einen Fotografen mit seiner Geschichte, seiner Persönlichkeit, seinem Ruf.

Der Aufbau einer persönlichen Marke ist daher wichtiger denn je. Das bedeutet nicht, zum Instagram-Influencer zu werden, sondern authentisch zu kommunizieren, wer Sie sind und wofür Sie stehen. Was ist Ihre Philosophie? Was treibt Sie an? Was macht die Zusammenarbeit mit Ihnen besonders?

Nutzen Sie Ihre Website, Ihre sozialen Medien, Ihre Kundeninteraktionen, um diese Marke zu vermitteln. Teilen Sie Einblicke in Ihren Arbeitsprozess, erzählen Sie die Geschichten hinter Ihren Bildern, zeigen Sie Ihre Persönlichkeit. Je mehr Kunden Sie als Menschen kennenlernen, desto loyaler werden sie sein.

Erlebnisorientierung verstärken

Ein Aspekt, den KI niemals ersetzen kann, ist das Erlebnis einer Foto-Session. Für viele Kunden – besonders im Bereich Porträt, Familie, Hochzeit – ist das Shooting selbst ein wertvoller Teil des Gesamtpakets.

Fotografen können diesen Erlebnisaspekt bewusst verstärken. Gestalten Sie Ihre Sessions als besondere Erfahrungen. Bieten Sie mehr als nur Bilder: Beratung bei der Outfitwahl, angenehme Atmosphäre im Studio, persönliche Betreuung, nachhaltige Erinnerungen. Ein Familienfoto kann eine KI generieren – aber den Nachmittag im Park, an dem die Kinder vor der Kamera herumtollen, kann sie nicht ersetzen.

Diese Erlebnisorientierung rechtfertigt auch höhere Preise. Kunden zahlen nicht nur für Dateien, sondern für Zeit, Aufmerksamkeit und eine besondere Erfahrung. Das ist ein Geschäftsmodell, das KI-resistent ist.

Neue Dienstleistungen entwickeln

Die KI-Revolution eröffnet nicht nur Bedrohungen, sondern auch Chancen für neue Dienstleistungen. Kreative Fotografen finden Wege, die Technologie für innovative Angebote zu nutzen.

Ein Beispiel: KI-unterstützte Bildrestaurierung. Alte, beschädigte Familienfotos können mit modernen Tools in beeindruckender Qualität restauriert werden. Fotografen mit dem nötigen Know-how können hier ein lukratives Zusatzgeschäft aufbauen.

Ein weiteres Beispiel: hybride Angebote, die echte Fotografie mit KI-generierten Elementen kombinieren. Eine Hochzeitsfotografin könnte neben den klassischen Dokumentaraufnahmen auch fantastische Composings anbieten, in denen das Brautpaar vor traumhaften KI-generierten Kulissen erscheint.

Auch Schulungen und Beratung werden zunehmend gefragt. Viele Unternehmen und Einzelpersonen wollen die neuen Tools nutzen, wissen aber nicht wie. Fotografen mit fundiertem Wissen können hier als Trainer und Berater auftreten.

Qualität und Ethik betonen

In einer Welt, in der jeder Bilder produzieren kann, wird Qualität zum entscheidenden Differenzierungsmerkmal. Qualität bedeutet dabei nicht nur technische Perfektion – die kann die KI zunehmend auch liefern – sondern umfasst den gesamten Prozess: Zuverlässigkeit, Kommunikation, Verständnis für die Kundenbedürfnisse, pünktliche Lieferung, professionelle Bildauswahl.

Auch ethische Standards werden wichtiger. In einer Zeit, in der Bilder manipuliert und gefälscht werden können, ist Vertrauenswürdigkeit ein Wert an sich. Fotografen, die transparent arbeiten, die ihre Bearbeitungsmethoden offenlegen, die keine übermäßige Retusche ohne Absprache vornehmen, bauen langfristiges Vertrauen auf.

Diese Betonung von Qualität und Ethik kann auch aktiv kommuniziert werden. Manche Fotografen bieten explizit KI-freie Pakete an oder dokumentieren ihren Workflow, um die Echtheit ihrer Bilder zu belegen. In bestimmten Märkten – Journalismus, Dokumentation, rechtlich relevante Aufnahmen – ist diese Authentizität nicht optional, sondern essentiell.

Teil 4: Praktische Strategien für verschiedene Fotografie-Bereiche

Porträt- und Hochzeitsfotografie

In diesen Bereichen ist der menschliche Faktor besonders wichtig. Kunden buchen nicht nur Bilder, sondern eine Begleitung durch wichtige Lebensmomente. Der Fokus sollte auf dem Beziehungsaufbau, der Erlebnisqualität und der persönlichen Marke liegen.

KI kann hier unterstützend wirken: effizientere Bearbeitung, schnellere Lieferung, kreative Composings als Zusatzangebot. Aber der Kern des Geschäfts bleibt menschlich. Investieren Sie in Ihre Soft Skills, in Kundenkommunikation, in das Schaffen unvergesslicher Erlebnisse.

Eine konkrete Strategie: Bieten Sie ein Beratungsgespräch vor jedem Shooting an. Nicht als lästige Pflicht, sondern als wertvolles Element Ihres Services. In diesem Gespräch lernen Sie Ihre Kunden kennen, verstehen ihre Wünsche und bauen Vertrauen auf. Das kann keine KI.

Produktfotografie und E-Commerce

Dieser Bereich ist stark von KI-Disruption betroffen. Generische Produktbilder auf weißem Hintergrund können zunehmend synthetisch erzeugt werden. Die Strategie muss daher in Richtung Mehrwert gehen.

Bieten Sie mehr als isolierte Produktfotos. Lifestyle-Aufnahmen mit echten Menschen, komplexe Szenarien, die schwer zu generieren sind, Videos und bewegte Inhalte. Werden Sie zum Berater für visuelle Markenkommunikation, nicht nur zum Foto-Lieferanten.

Eine weitere Strategie ist die Spezialisierung auf Produktkategorien, die komplexe technische Anforderungen haben: hochglänzende Oberflächen, transparente Materialien, Lebensmittel mit echtem Appetit-Appeal. In diesen Bereichen stoßen KI-Systeme noch an Grenzen.

Event- und Pressefotografie

Authentizität ist hier das entscheidende Kriterium. Nachrichtenagenturen und seriöse Medien benötigen verifizierbare Bilder realer Ereignisse. Diese Anforderung wird durch KI-Fälschungen sogar noch wichtiger.

Fotografen in diesem Bereich sollten ihre Workflow-Dokumentation optimieren. Metadaten, GPS-Koordinaten, Zeitstempel, Originaldateien – all das wird zum Qualitätsnachweis. Manche Organisationen entwickeln bereits Blockchain-basierte Systeme zur Verifizierung von Nachrichtenbildern.

Die menschliche Präsenz vor Ort bleibt unersetzbar. Ein Fotograf auf einer Demonstration, in einem Krisengebiet, bei einem historischen Ereignis – diese Zeugenschaft kann keine KI ersetzen.

Werbe- und Modefotografie

In der Werbefotografie ist die kreative Konzeption entscheidend. KI kann ein Bild generieren, aber nicht die strategische Überlegung dahinter: Welche Emotion soll ausgelöst werden? Wie passt das Bild zur Markenidentität? Wie hebt es sich vom Wettbewerb ab?

Positionieren Sie sich als Creative Director, nicht nur als Fotograf. Bieten Sie Konzeptentwicklung, Art Direction, Kampagnenberatung. Die technische Ausführung – ob mit Kamera oder mit KI-Unterstützung – ist dann nur noch ein Werkzeug zur Umsetzung Ihrer kreativen Vision.

In der Modefotografie kommt der Beziehungsaspekt hinzu. Die Arbeit mit Models, Stylisten, Make-up-Artists ist ein komplexes menschliches Zusammenspiel. Die Atmosphäre am Set, die Chemie zwischen Fotograf und Model – das sind Faktoren, die das Ergebnis prägen und nicht simuliert werden können.

Teil 5: Der Blick nach vorn

Die Technologie wird weitergehen

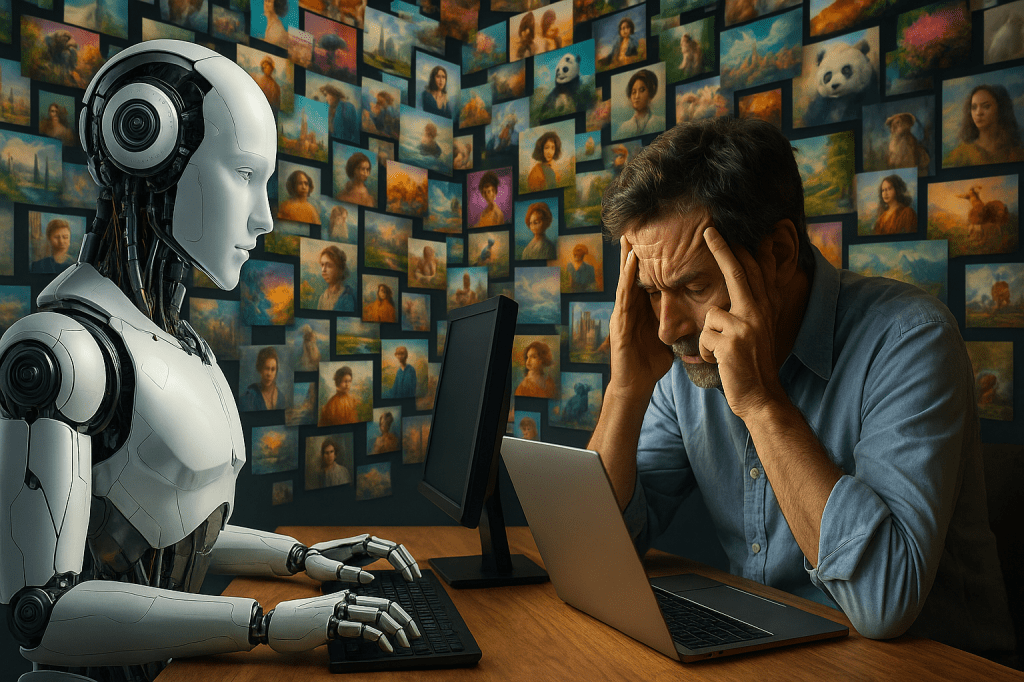

Machen wir uns nichts vor: Die KI-Entwicklung wird nicht stoppen. Was heute beeindruckt, wird morgen übertroffen. Die Grenzen, die wir heute als Sicherheitszone für menschliche Fotografen sehen, könnten morgen fallen.

Doch diese Entwicklung ist nicht neu. Bei jeder technologischen Revolution in der Fotografie haben Pessimisten das Ende des Berufsstands vorhergesagt. Als Kodak die Rollfilmkamera einführte, fürchteten Studiofotografen um ihre Existenz. Als Digitalfotografie kam, sollte es keine Profis mehr brauchen. Jedes Mal hat sich die Branche angepasst und neu erfunden.

Die Fotografen, die überlebt haben, waren diejenigen, die Veränderung als Chance begriffen. Die neue Technologien nutzten statt sie zu bekämpfen. Die ihre Rolle neu definierten statt an überholten Modellen festzuhalten.

Was bleibt, ist das Menschliche

Bei aller Unsicherheit gibt es eine Konstante: Das fundamental Menschliche an der Fotografie wird bestehen. Der Wunsch, echte Momente festzuhalten. Die Sehnsucht nach authentischen Bildern echter Menschen. Die Wertschätzung für einen anderen Menschen, der mit seinem Blick, seiner Erfahrung, seiner Persönlichkeit einen Moment interpretiert.

KI kann Pixel erzeugen, aber keine Erfahrungen teilen. Sie kann Gesichter generieren, aber keine Beziehungen aufbauen. Sie kann Stile imitieren, aber keine eigene Perspektive entwickeln. Solange Menschen Menschen bleiben, werden sie diese menschlichen Qualitäten suchen und schätzen.

Die Synthese

Die Zukunft gehört vermutlich weder der reinen menschlichen Fotografie noch der vollständig KI-generierten Bildwelt, sondern einer Synthese aus beiden. Fotografen, die lernen, menschliche Kreativität mit maschineller Effizienz zu verbinden, werden die Gewinner sein.

Diese Synthese erfordert neue Fähigkeiten, neue Denkweisen, neue Geschäftsmodelle. Sie erfordert Offenheit für Technologie bei gleichzeitiger Betonung des Menschlichen. Sie erfordert Anpassungsfähigkeit bei gleichzeitiger Treue zu dem, was Fotografie im Kern ausmacht.

Fazit: Nicht Opfer, sondern Gestalter sein

Die KI-Revolution in der Fotografie ist real und unaufhaltsam. Sie verändert, wie Bilder entstehen, bearbeitet und konsumiert werden. Sie stellt Geschäftsmodelle in Frage, die über Jahrzehnte funktioniert haben. Sie fordert jeden Fotografen heraus, seinen Platz in einer neuen Landschaft zu finden.

Doch diese Revolution ist keine Naturkatastrophe, der man hilflos ausgeliefert ist. Sie ist eine Transformation, die gestaltet werden kann. Fotografen haben die Wahl: Opfer des Wandels zu werden oder ihn aktiv mitzugestalten.

Die Strategien sind klar: Technologische Kompetenz entwickeln, ohne sich der Technologie zu unterwerfen. KI als Werkzeug nutzen, nicht als Ersatz für eigene Kreativität. Die eigene Nische schärfen und eine unverwechselbare persönliche Marke aufbauen. Erlebnisorientierung verstärken und den menschlichen Faktor betonen. Neue Dienstleistungen entwickeln und offen für Veränderung bleiben.

Am Ende wird die Frage nicht sein, ob KI Fotografen ersetzen kann. Die Frage wird sein, welche Fotografen die Kunst beherrschen, das Beste aus beiden Welten zu vereinen: die Effizienz und Möglichkeiten der Technologie mit der Kreativität, Empathie und Authentizität, die nur Menschen bieten können.

Die Fotografie ist nicht am Ende. Sie beginnt ein neues Kapitel. Und wie bei jedem neuen Kapitel werden diejenigen am meisten profitieren, die mit Neugier statt mit Angst hineinblättern. Die Zukunft der Fotografie wird von Menschen geschrieben – von Fotografen, die verstehen, dass ihr wertvollstes Werkzeug nicht die Kamera ist, nicht die Software, nicht die KI, sondern ihr eigener, unersetzbar menschlicher Blick auf die Welt.